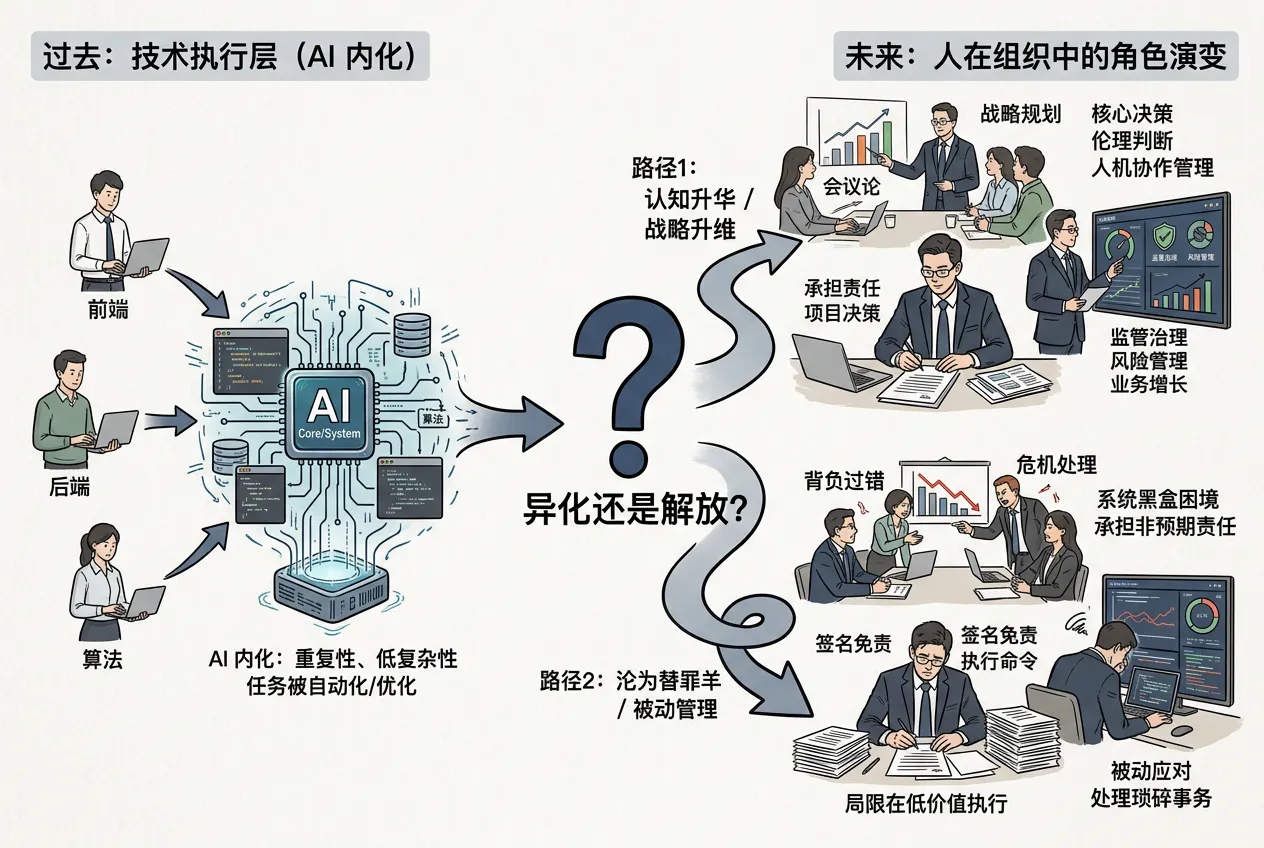

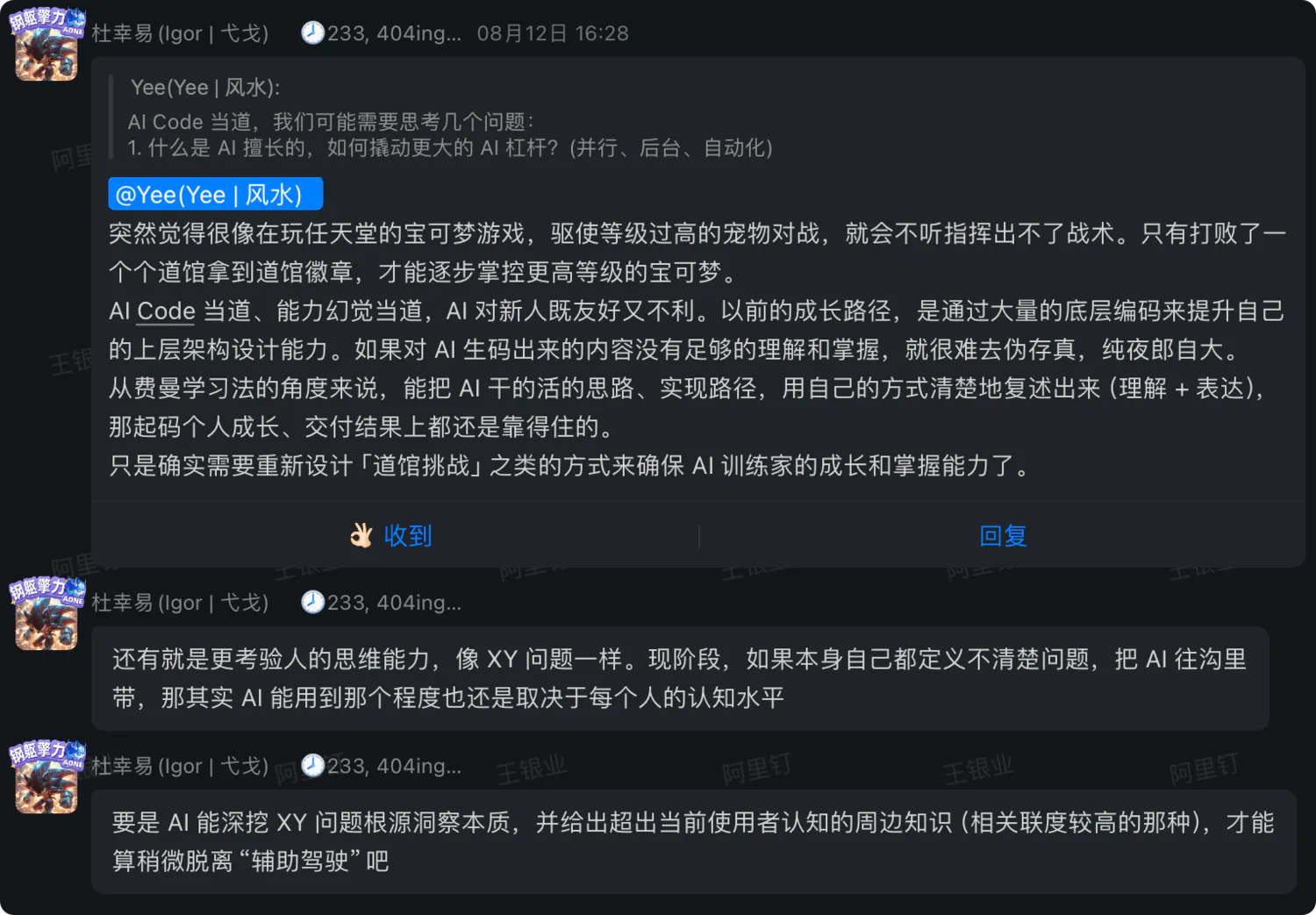

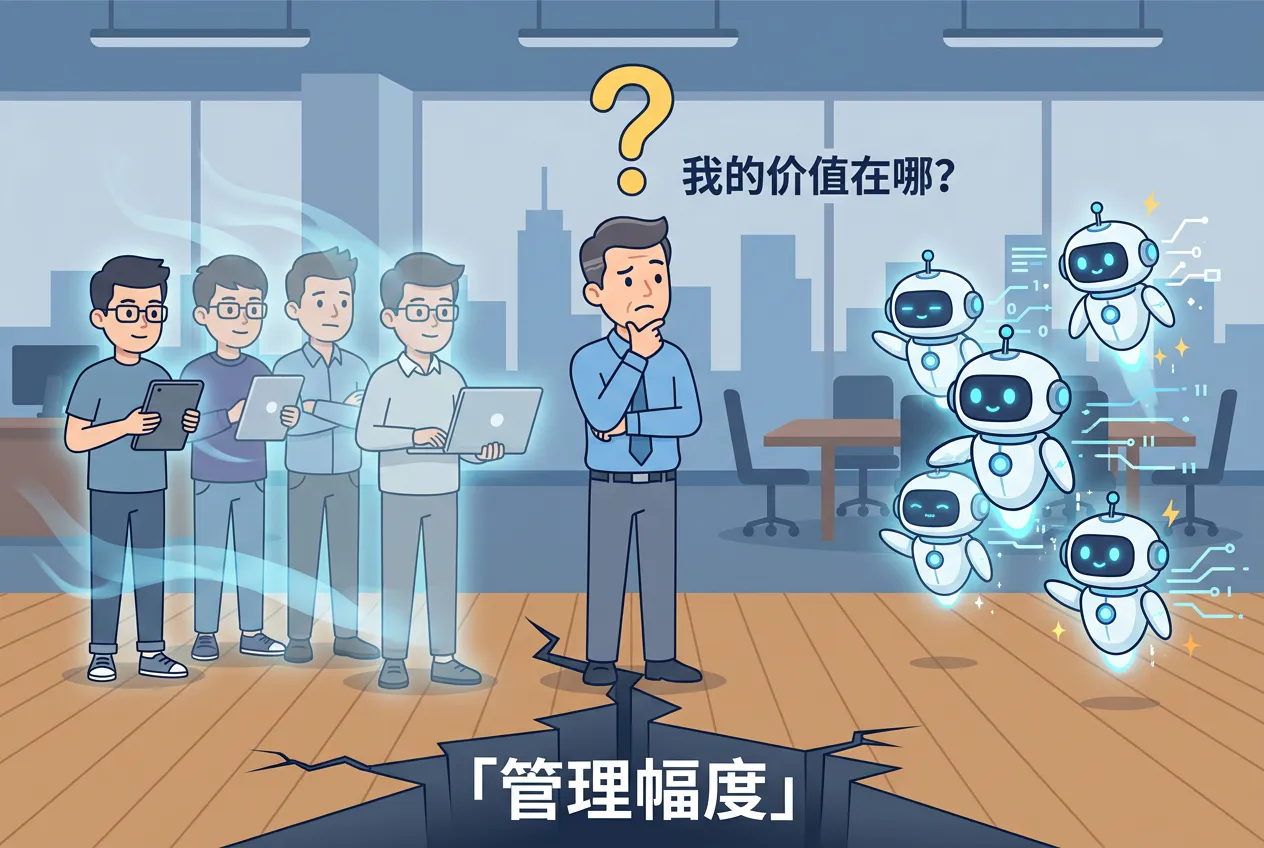

读完之后我沉默了很久,因为那篇文章讨论的是”写代码的人”,而我这种人——技术中层管理者——离代码更远,但离那个”政治性角色”更近。如果执行层都在被替代,那管理执行层的人呢?

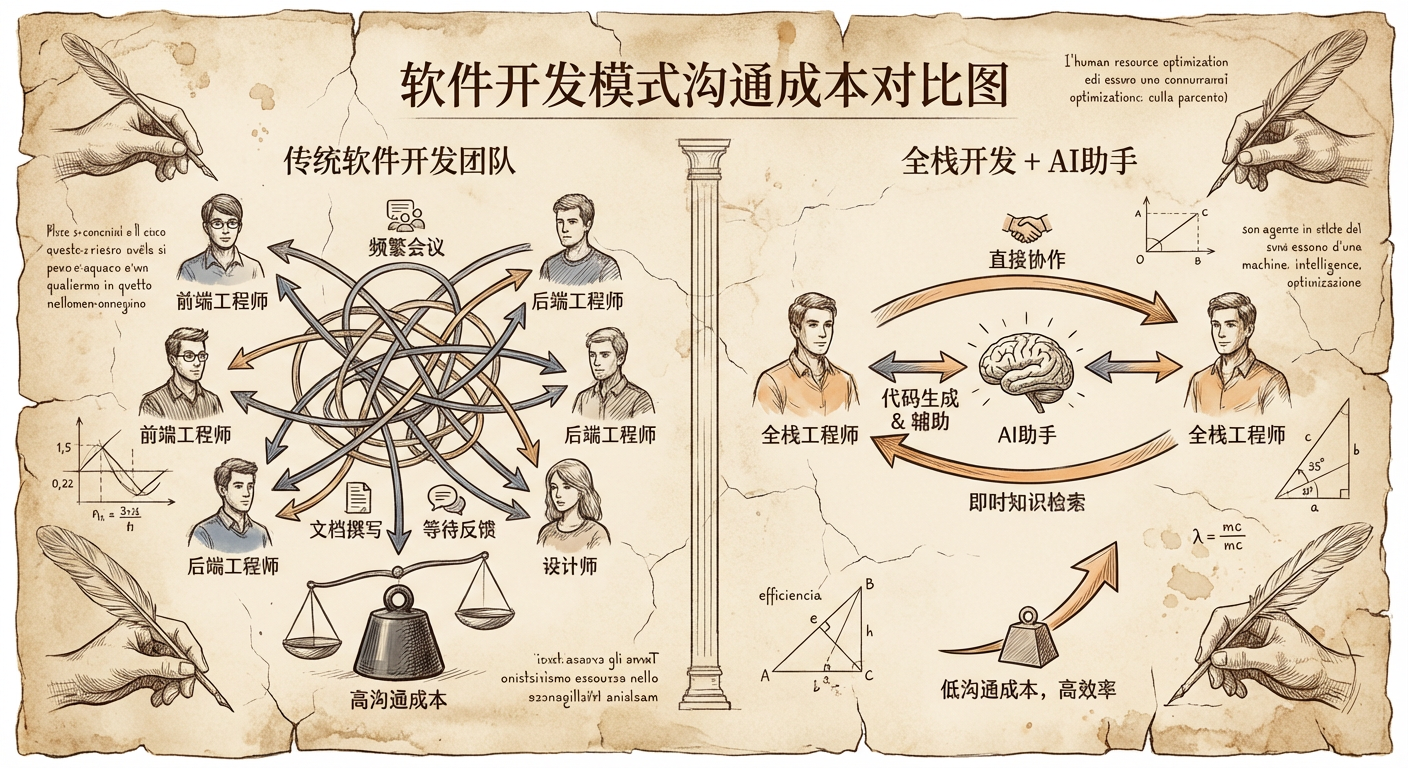

我在大厂带过三十多人的团队,后来在中型公司管一个技术部门。坦率讲,我已经很久没写过生产代码了。我的日常是开会、拉齐、拍板、写周报、做汇报、处理人事问题、在各种利益方之间找平衡。

现在 AI 来了,我得认真想一个问题:我这类角色,到底在卖什么?

辩题

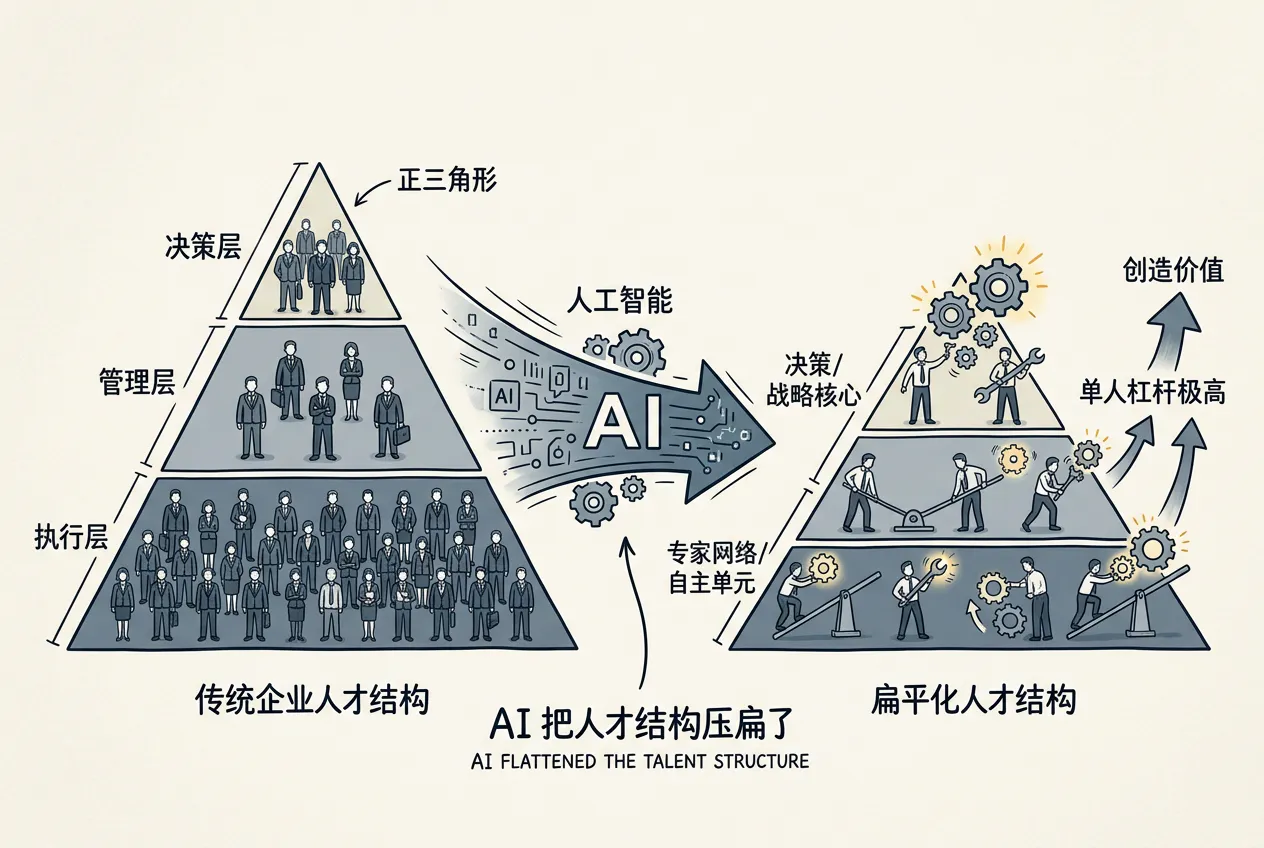

在 AI 时代,纯管理型技术中层将面临比执行层更深层的价值危机——因为他们的存在前提是”需要管理大量人”,而这个前提正在被 AI 从根基上瓦解。

第一轮|为什么会有大量”我们”存在,而且能拿到高薪?

🔵 正方:你们是信息损耗的副产品

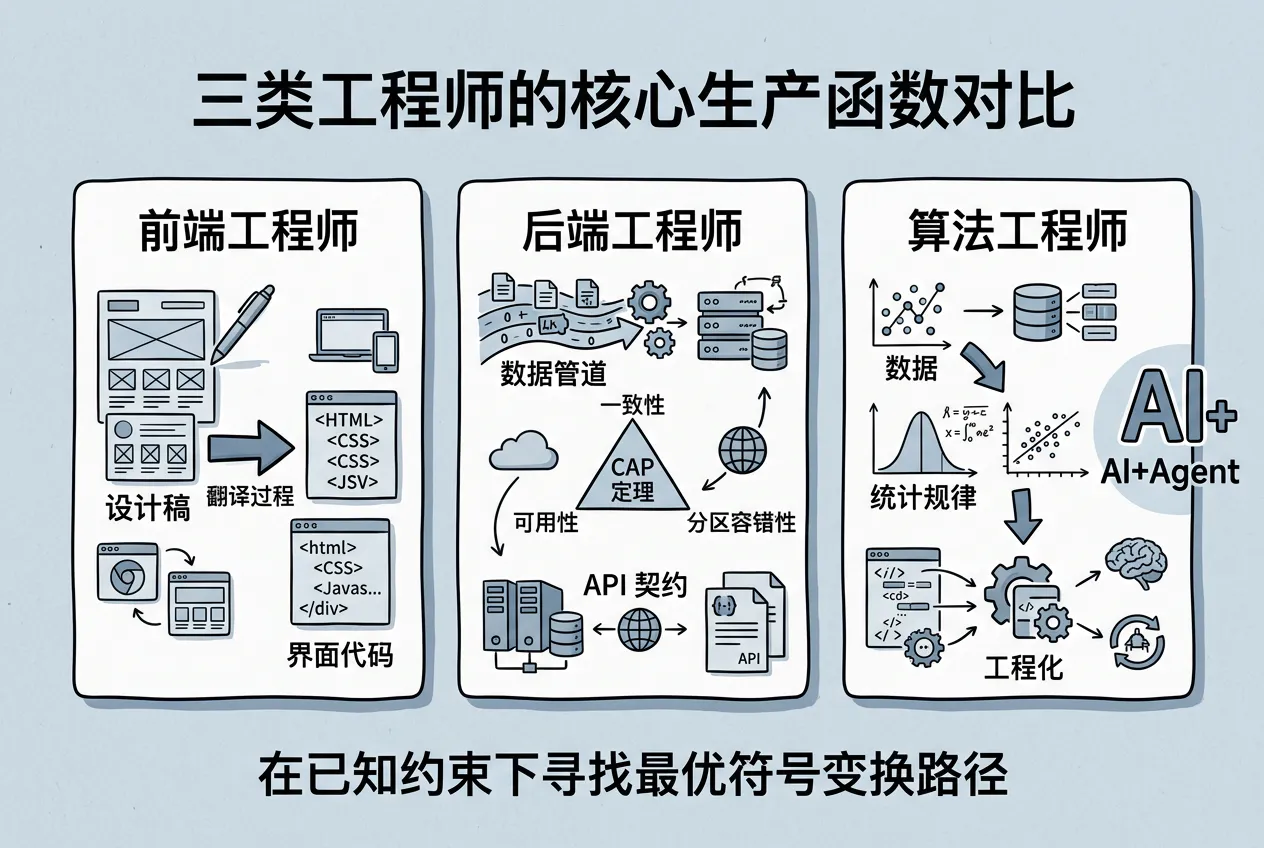

从第一性原理出发:技术中层管理者的核心生产函数是什么?

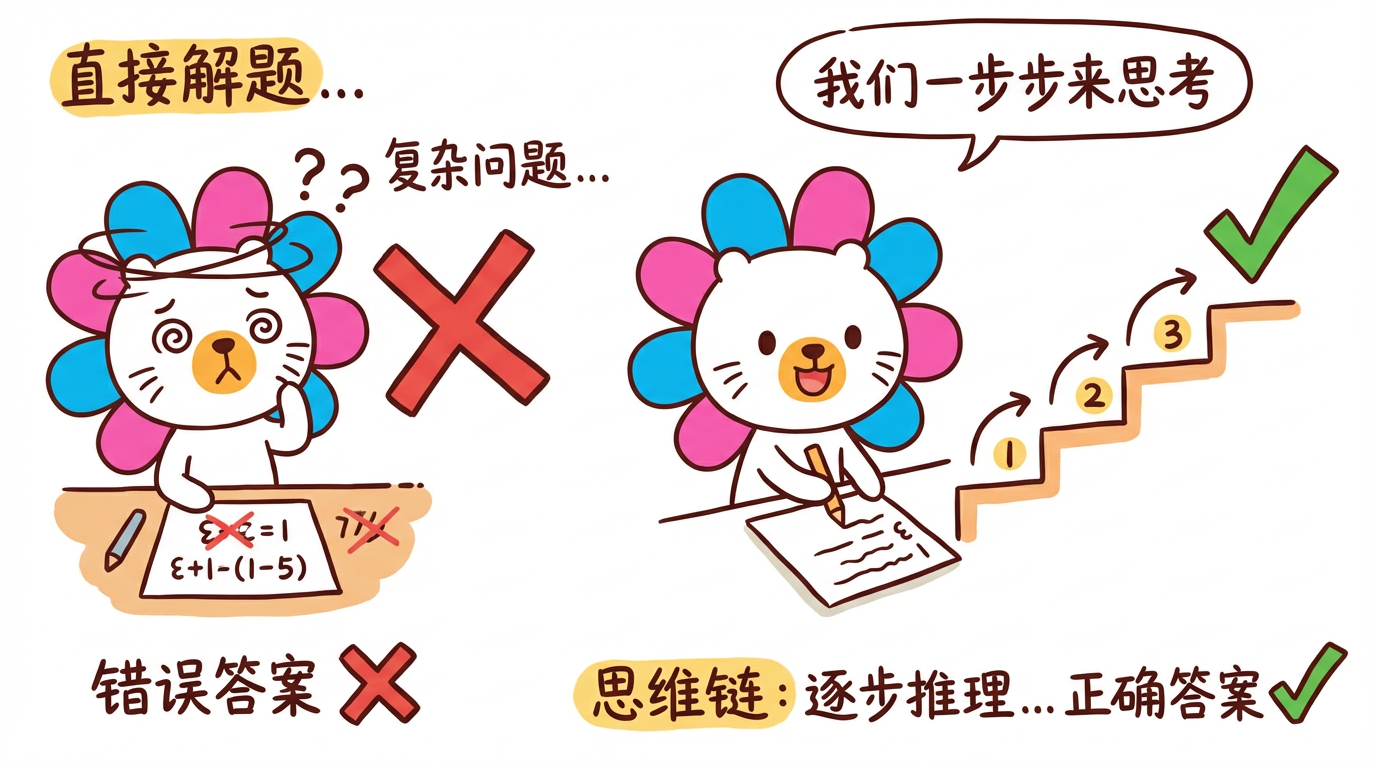

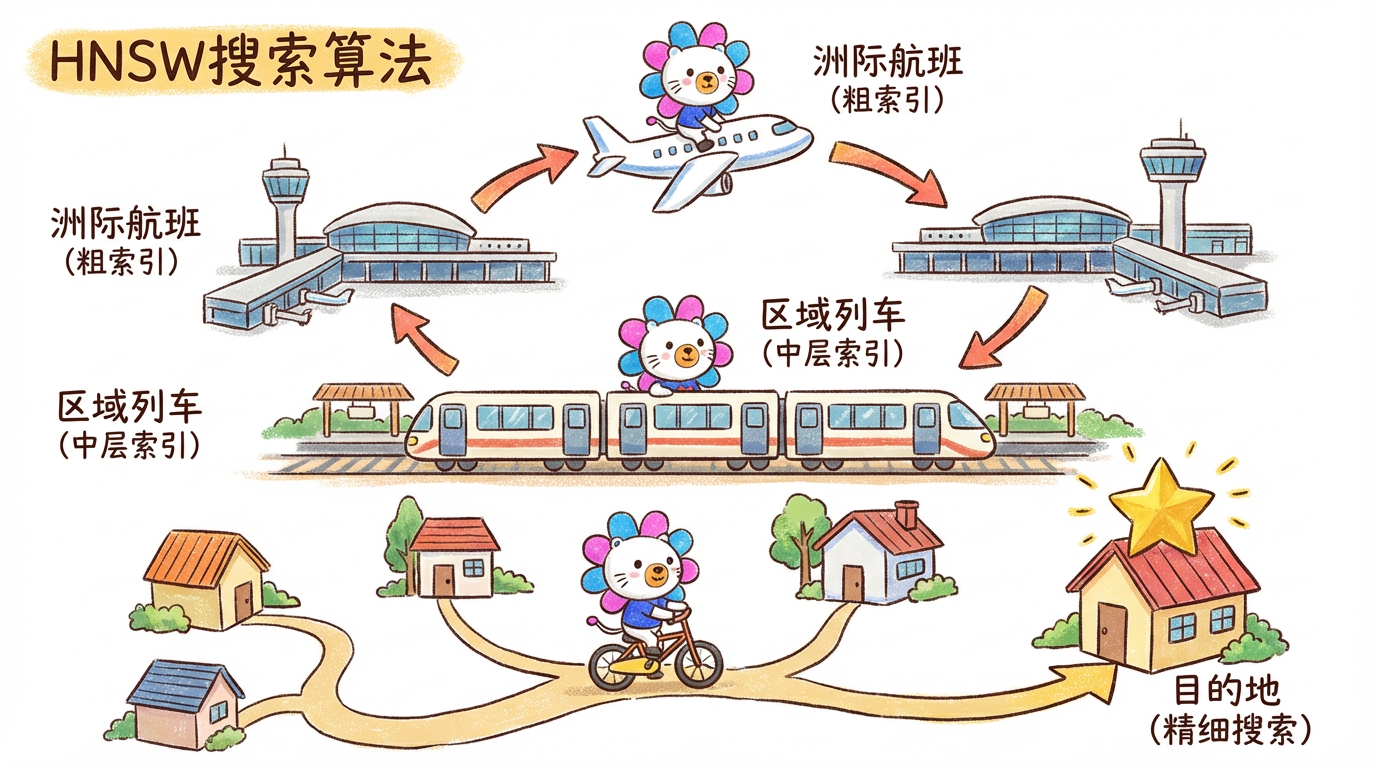

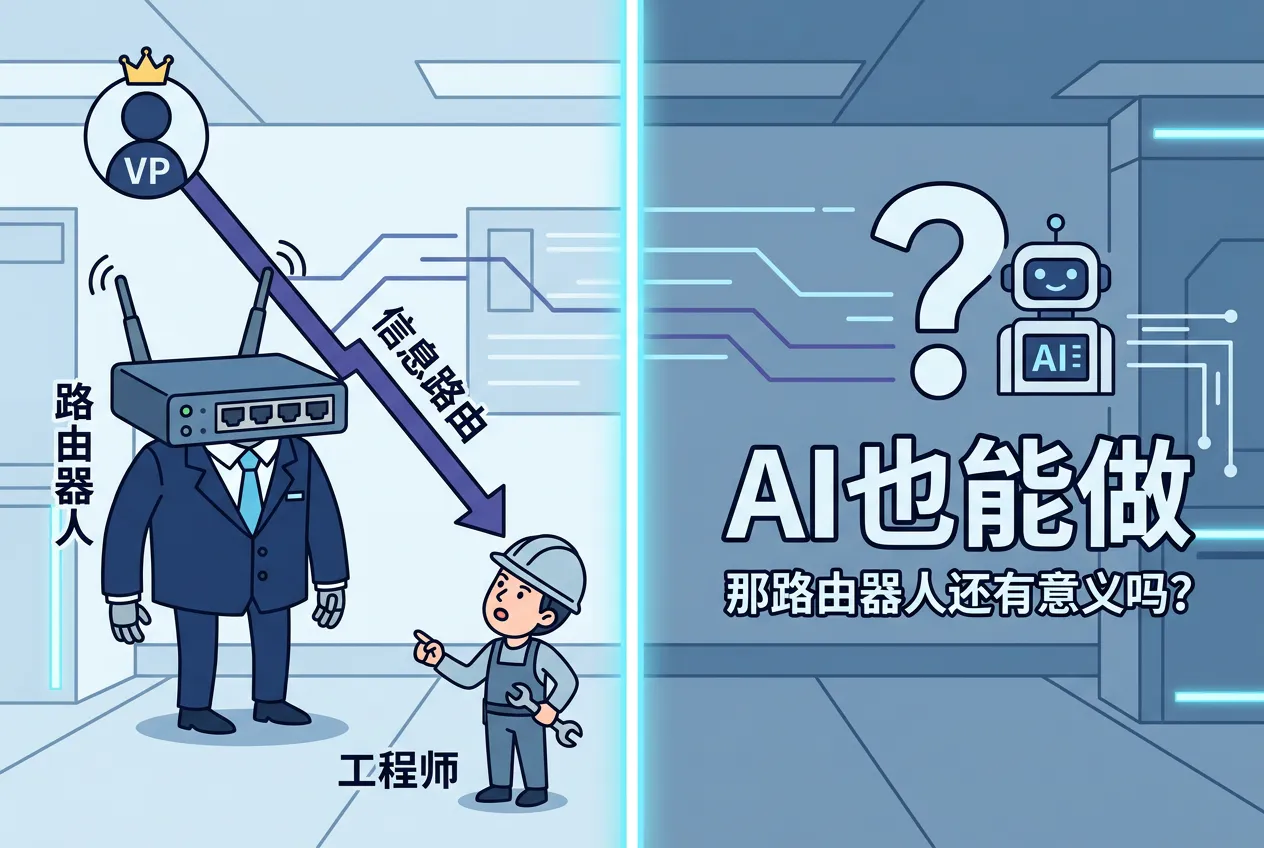

不是写代码,不是做架构决策,甚至不是”管理”本身——而是在一个信息传递损耗极大的组织里,充当人肉路由器。

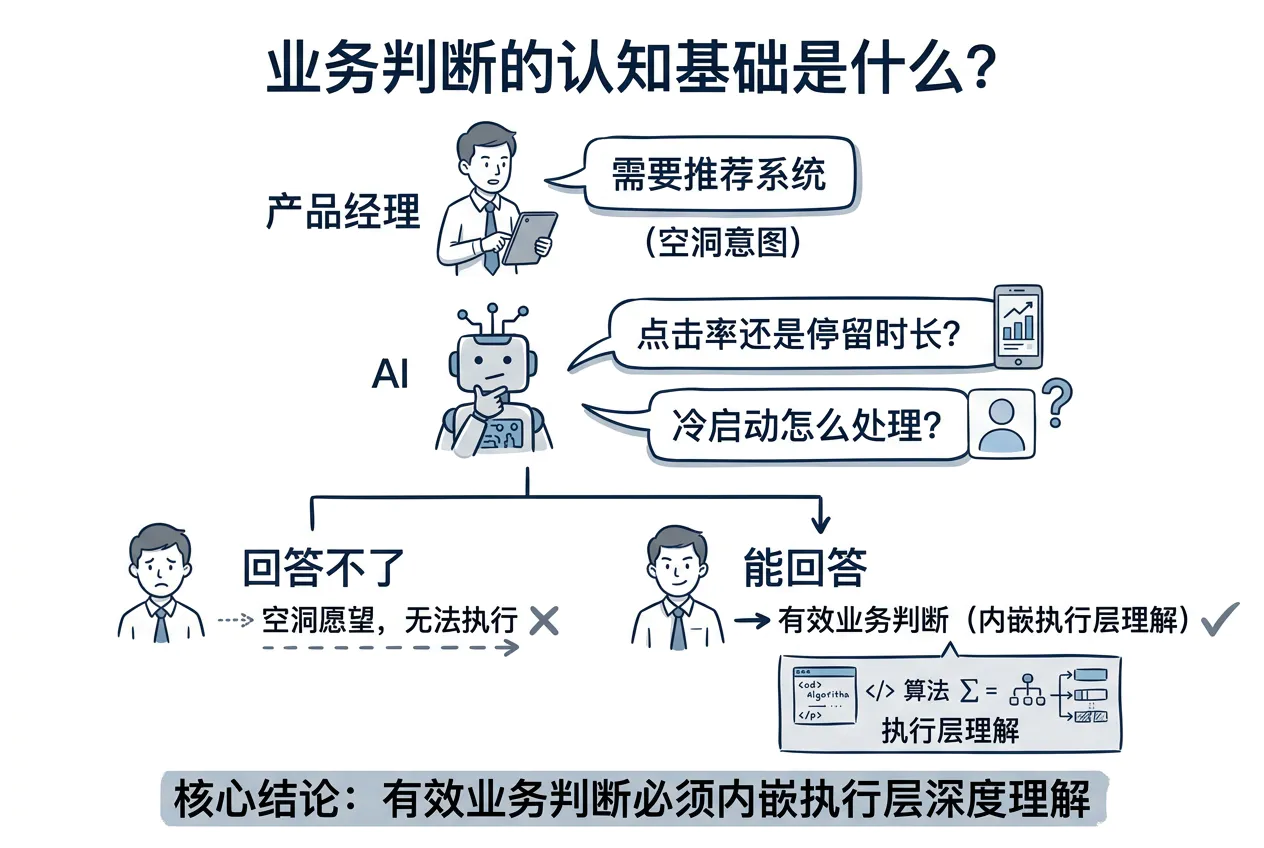

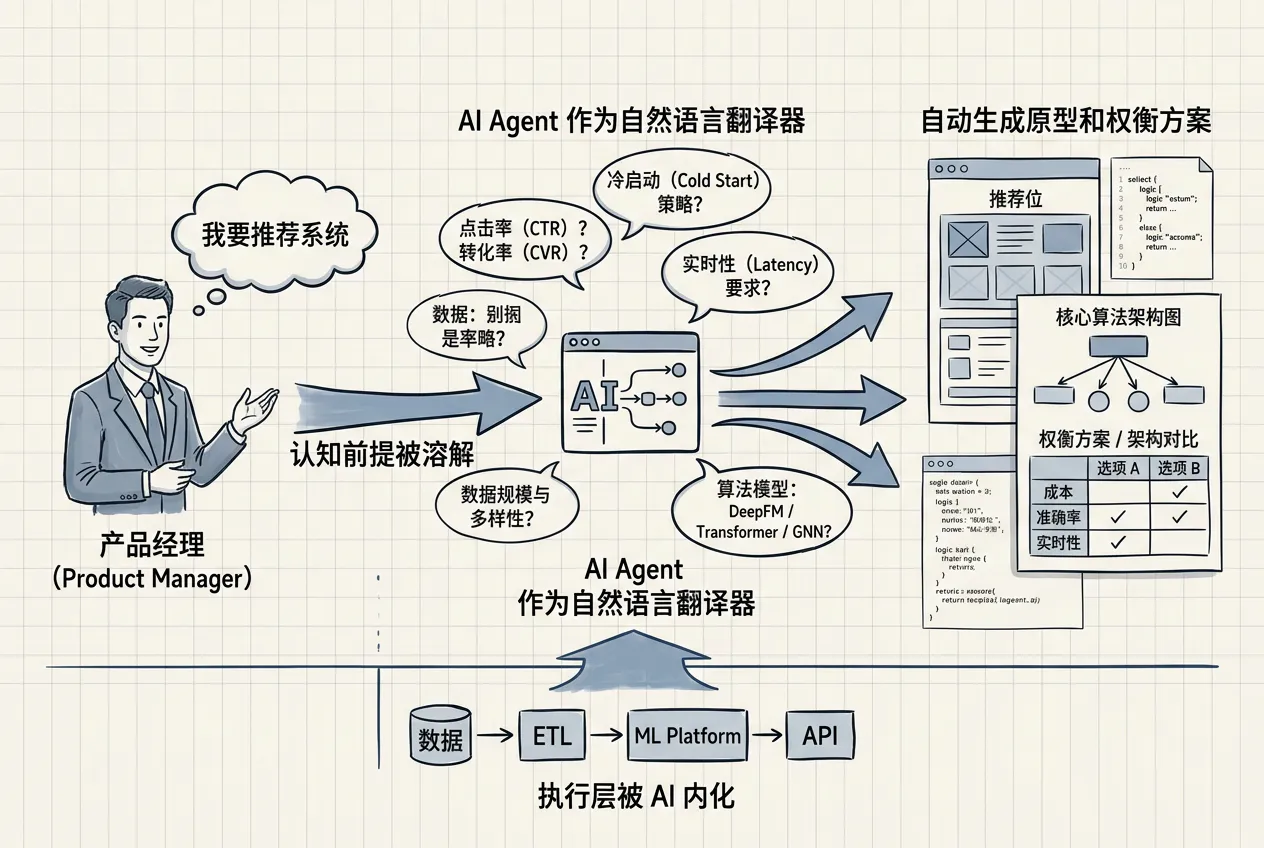

为什么需要这个路由器?因为过去的软件工程有一个基本矛盾:业务意图是自然语言的、模糊的、政治化的,而技术实现是形式化的、精确的、确定的。 这两套语言体系之间存在巨大的阻抗失配。

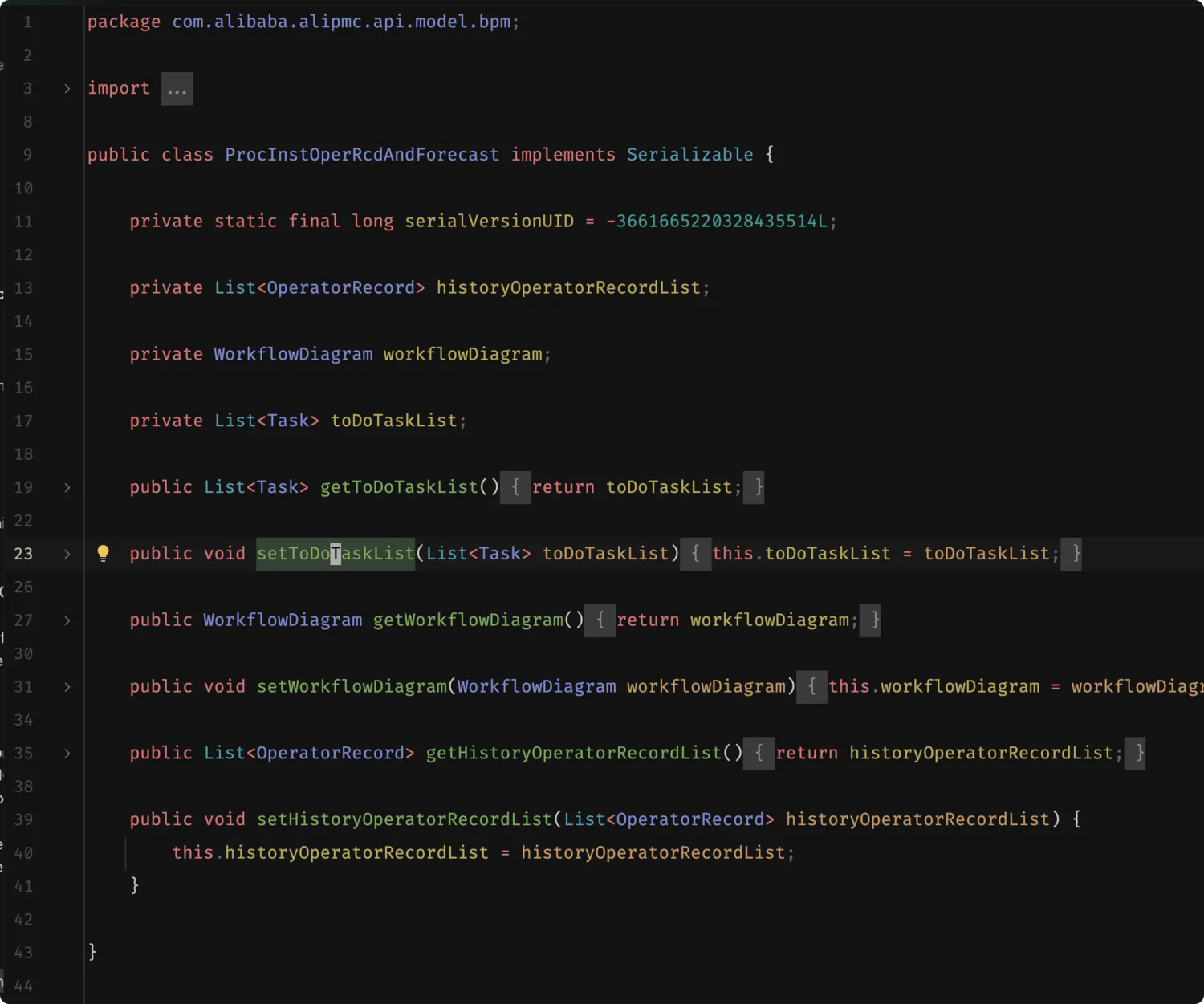

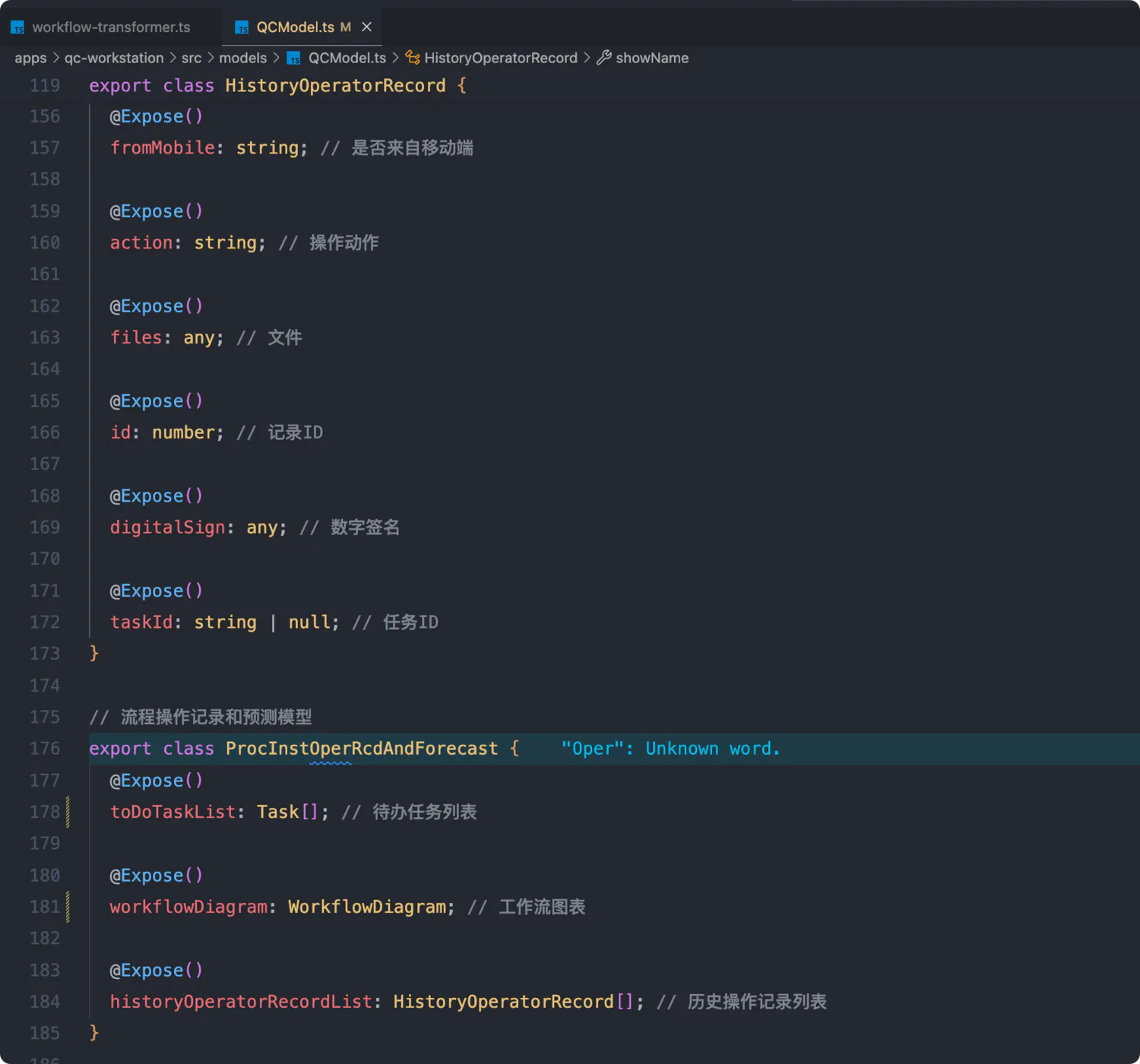

一个 VP 说”我们要做用户增长”,到了工程师面前必须变成”在注册流程第三步加一个 A/B 测试,对照组走原流程,实验组用手机号一键登录,埋点用 XX 方案”。这个翻译过程需要人来做,而且不是一次翻译就够——需要反复澄清、对齐、拆解、排优先级。

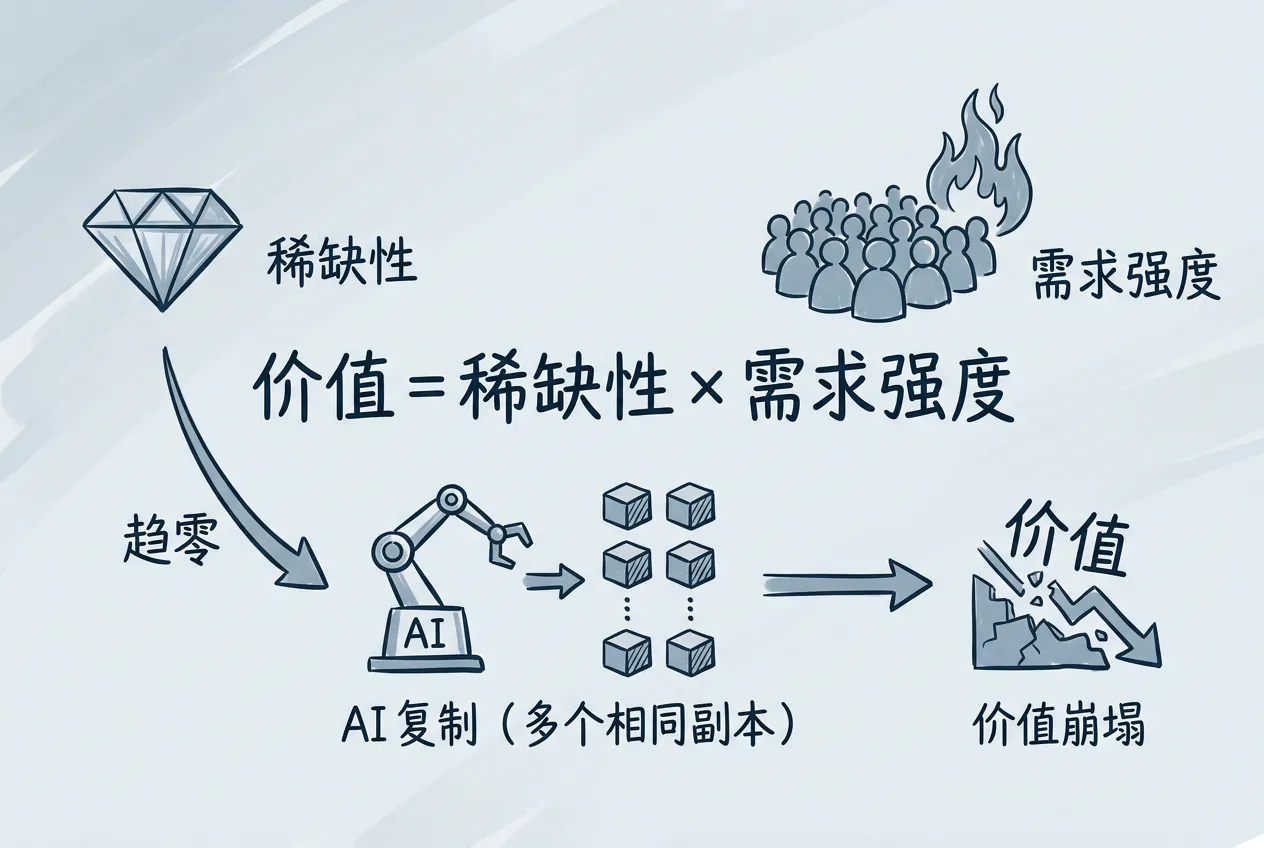

技术中层管理者的高薪,本质上是在为组织的信息传递损耗买单。

公司越大,层级越多,信息损耗越大,需要的”人肉路由器”就越多,每个路由器的价格就越高——因为一个好的技术经理和一个差的技术经理之间的信息损耗差异,可能意味着一个季度几百万的研发浪费。

但请注意这个逻辑的前提:这一切成立的条件,是信息传递必须经过人。

当 AI Agent 可以在自然语言和技术实现之间做实时翻译、自动拆解、自动追问时——你作为”人肉路由器”的稀缺性,会发生什么?

正方论点:AI 能做同样的翻译,路由器式管理者的稀缺性将被摧毁

🔴 反方(我):你连管理是什么都没搞清楚

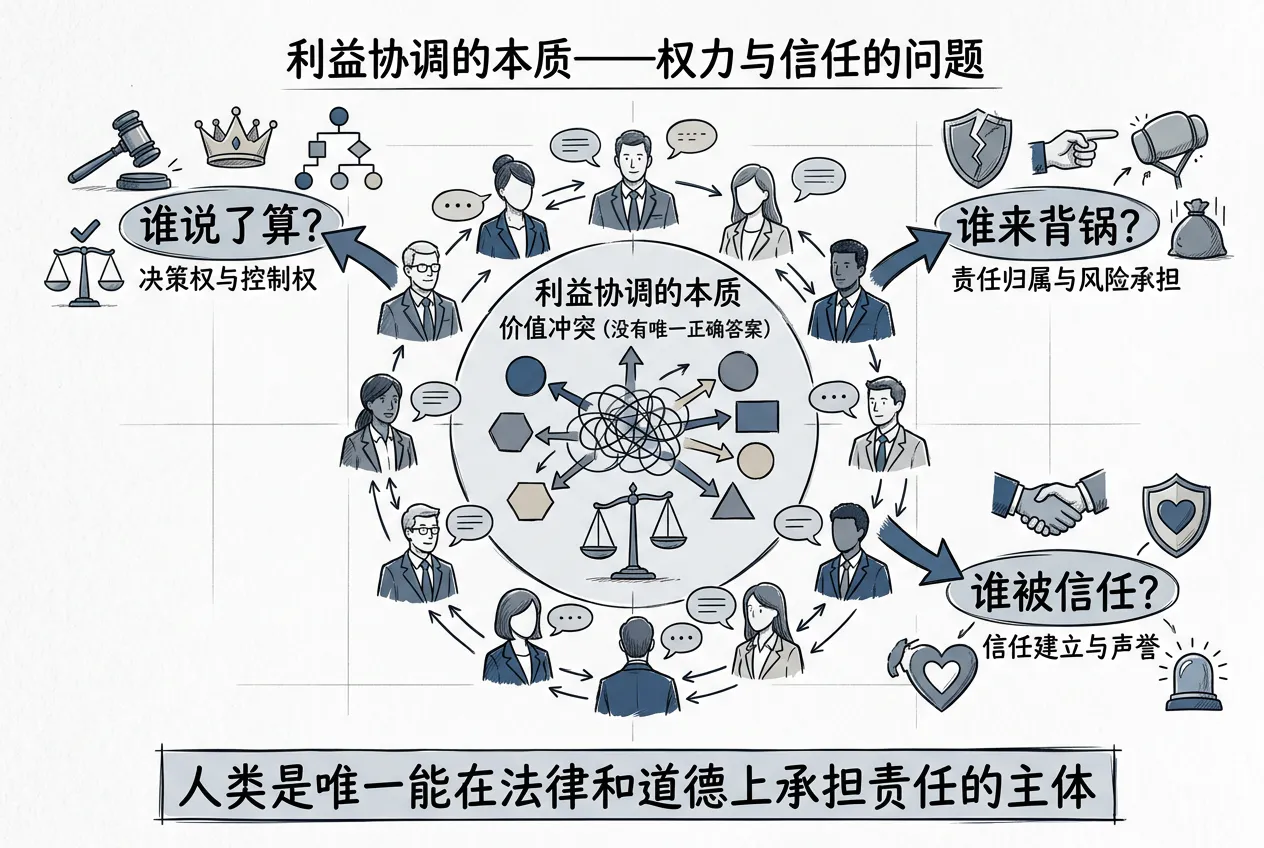

你的整个论证建立在一个对管理的根本误解之上:你以为管理是信息传递,但管理的本质是处理人的不可计算性。

让我用最直白的方式告诉你,我的日常到底在做什么。

第一件事:我在处理人的冲突,不是信息的冲突。

张三和李四有技术路线分歧,张三想用微服务,李四觉得单体够用。你以为这是个技术问题?错了。底下是:张三刚晋升,需要一个有影响力的项目来站稳脚跟;李四是老员工,觉得自己的经验被忽视。你让 AI 来做”实时翻译”——翻译什么?翻译张三的不安全感?翻译李四的被边缘化焦虑?

我要做的是:在技术上找一个双方都能接受的方案,同时在情绪上安抚那个”没赢”的人。这件事的本质不是认知问题,是权力和面子的博弈。AI 连博弈的存在都感知不到。

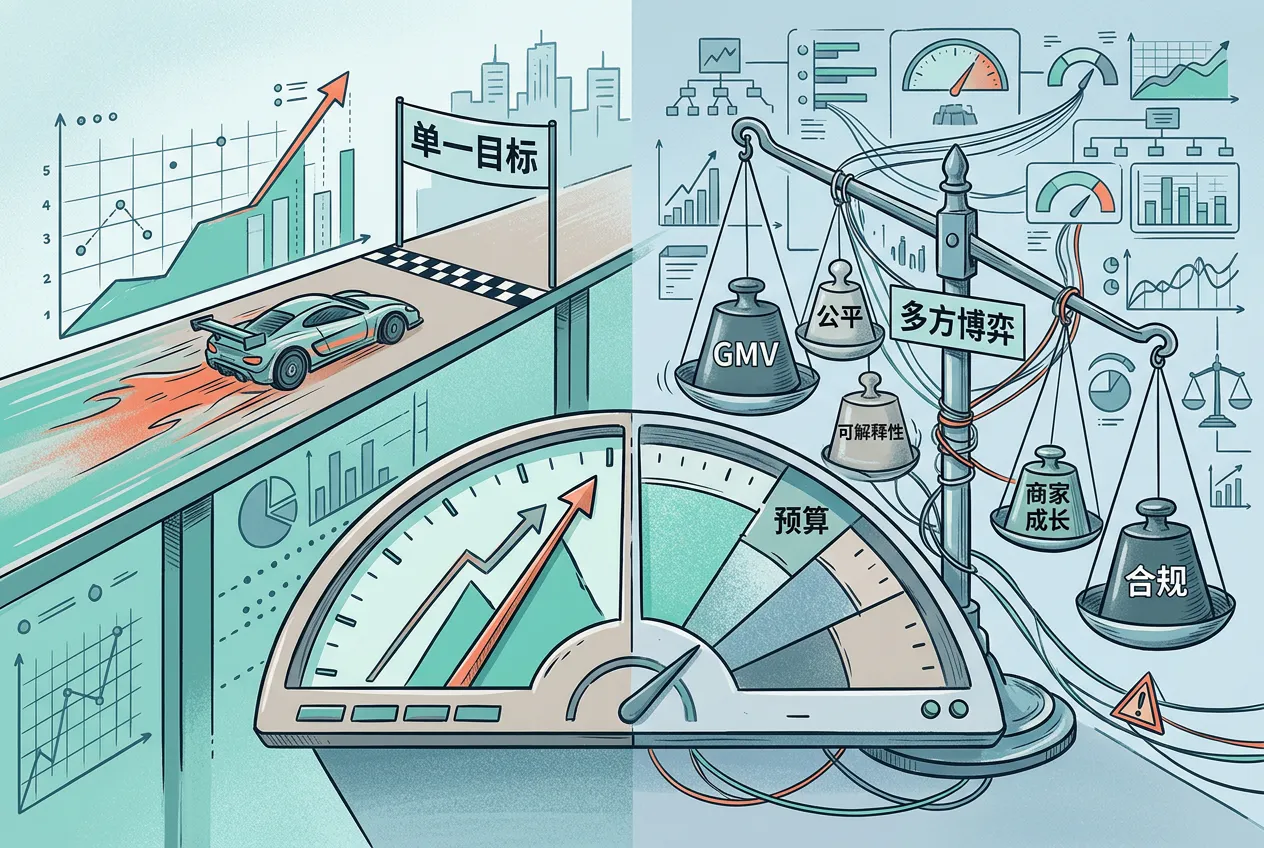

第二件事:我在处理没有目标函数的优先级排序。

任何一个季度,摆在我面前的事情永远比资源多三倍。技术债要还,新功能要上,稳定性要保障,还有 CTO 临时塞进来的”战略项目”。这些事情之间没有客观的优先级——它取决于公司当前的政治格局、业务的真实紧迫度(不是 PPT 上写的那种)、团队当前的士气和状态、以及我对三个月后形势的判断。

你没法给 AI 一个目标函数让它优化,因为目标函数本身就是模糊的、多维的、而且不同利益方给出的权重是矛盾的。

第三件事:我在做组织的减震器,不是路由器。

当上面的压力传下来——“为什么这个项目延期了””为什么线上出了 P1 故障”——我是挡在团队前面的那个人。我在吸收组织上层的焦虑和非理性情绪,把它翻译成团队能接受的信号,同时把团队的真实困难翻译成上层能理解的语言。

如果没有我这层缓冲,工程师直接面对 VP 的压力,要么崩溃,要么说谎,要么躺平。这三种结果对公司都是灾难。

你把我的工作降格成”信息路由”,是因为你根本没见过组织现实的脏活。信息损耗只是冰山的水面部分——水下是权力、情绪、面子、恐惧、野心。这些东西不在任何文档里,不在任何对话的文字表层,AI 的训练数据里也没有。

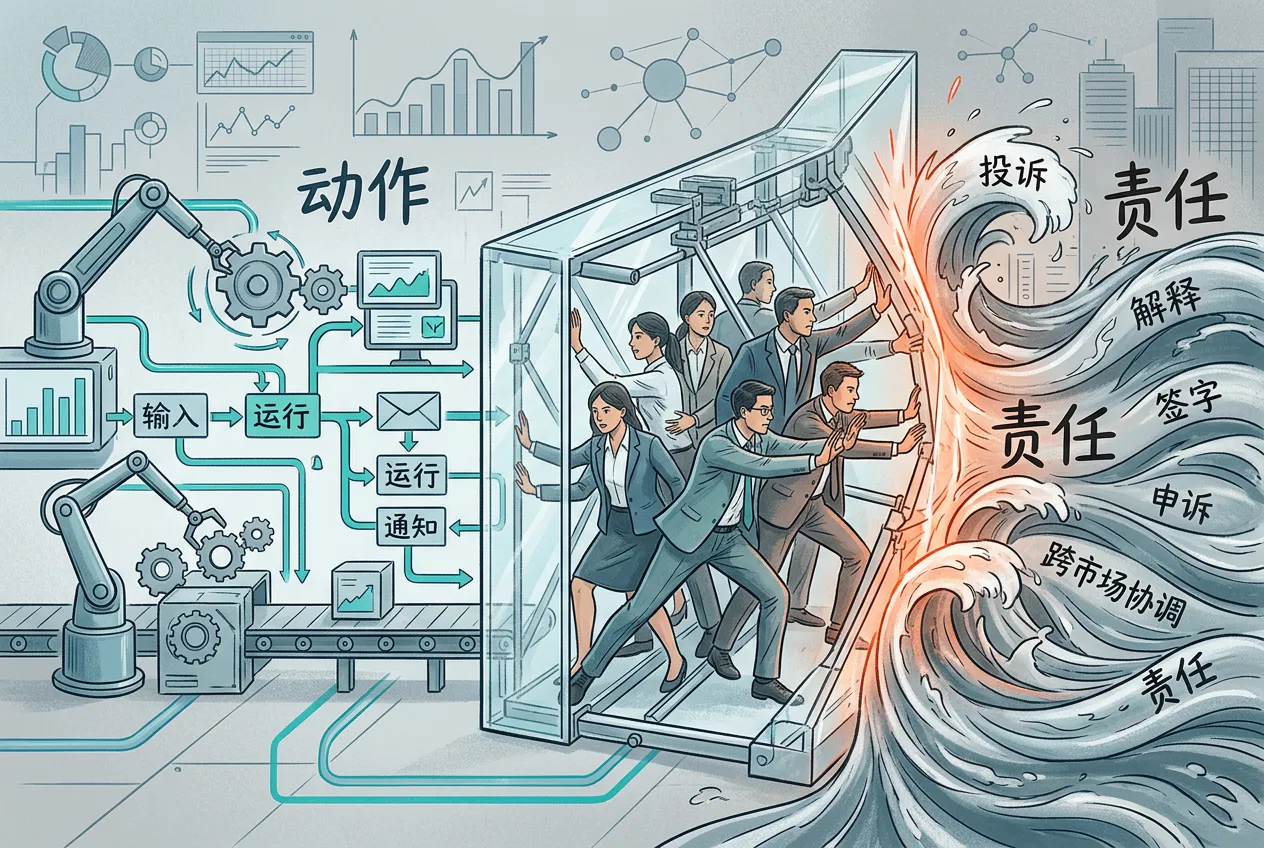

不是信息路由器,是减震器 · 翻译器 · 政治缓冲层

第二轮|”花 80% 时间 Coding 就不配当管理者”——这句话到底在说什么?

🔵 正方:它在说,你的稀缺性必须来自代码之外

这句话在过去的技术管理圈几乎是信条。但从第一性原理来拆解,它的深层逻辑是什么?

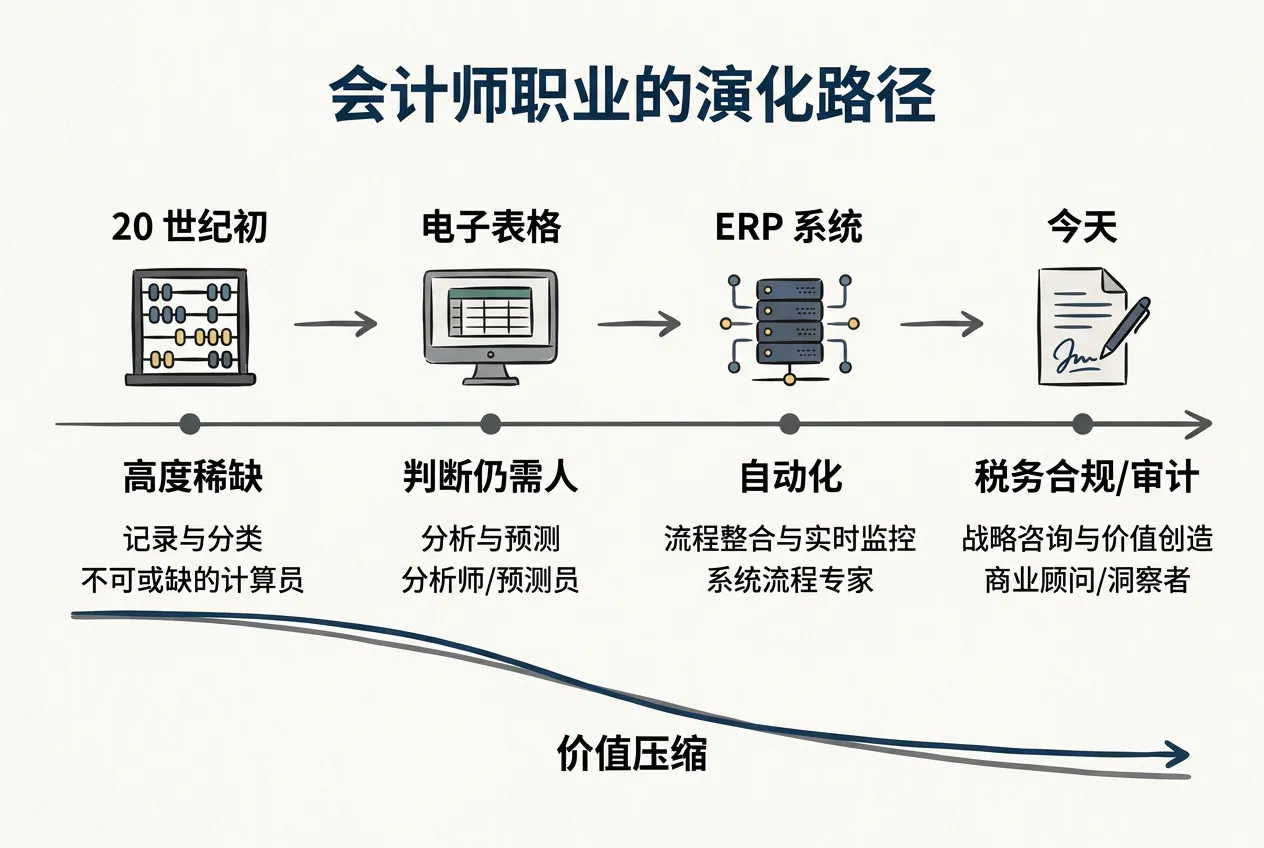

它其实在说:在传统软件工程的组织结构下,代码产出是最容易被规模化分摊的资源,而人际协调、利益平衡、决策判断是无法被分摊的瓶颈。

一个管理者花 80% 的时间写代码,意味着他把自己当成了一个高级工程师在用——但公司给他管理者的薪资和权限,不是为了买他的代码产出,而是为了买他对团队整体产出的乘数效应。

这里有一个关键的经济学逻辑:假设一个技术经理年薪 150 万,管 15 个人。如果他花 80% 时间写代码,他个人的代码产出可能值 80 万——但他放弃了对 15 个人的有效管理。如果他花 80% 时间在管理上,他自己不写代码,但能让每个人的效率提升 20%——那他产生的增量价值是 15 × 人均产出 × 20%,远超他个人写代码的贡献。

“不要花 80% 时间 Coding”的本质,是在说:你的杠杆在人,不在代码。把时间花在杠杆率最高的地方。

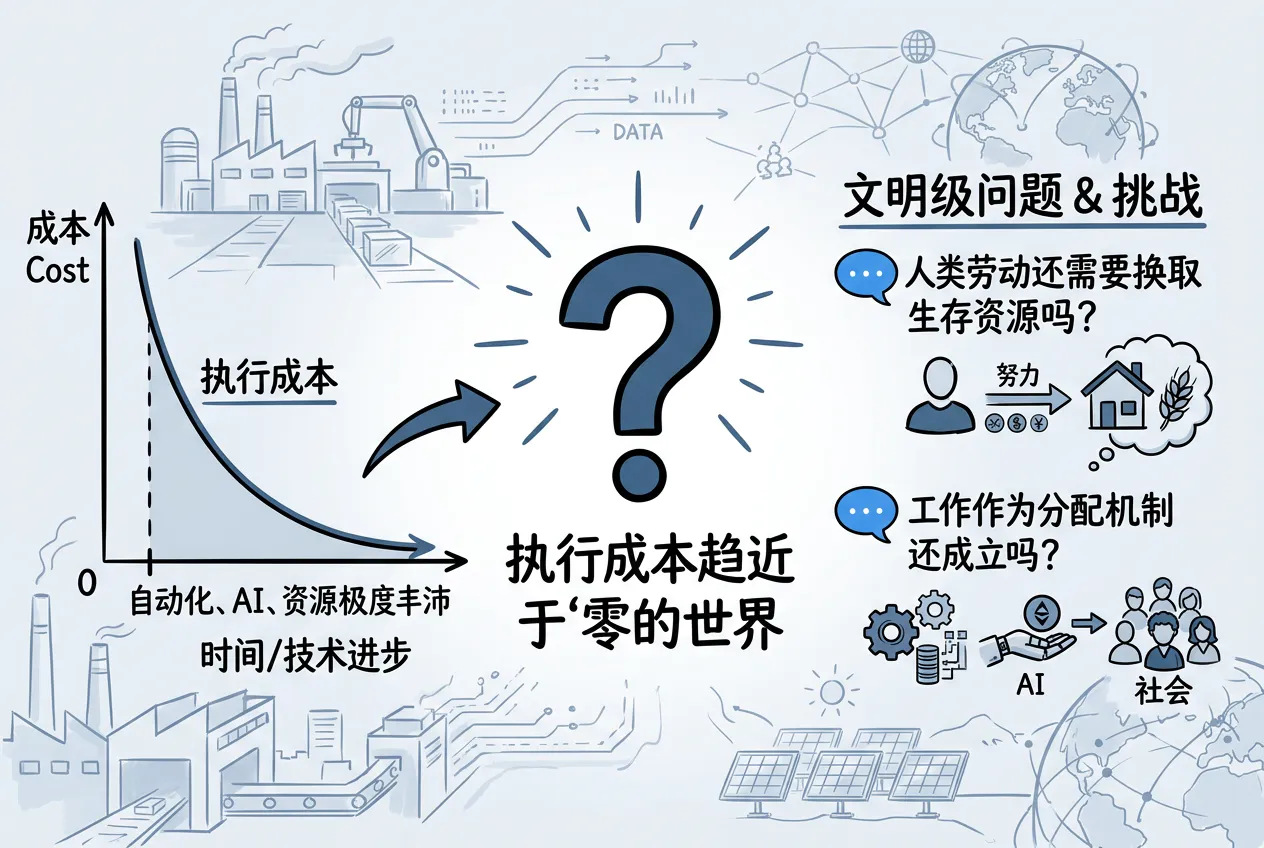

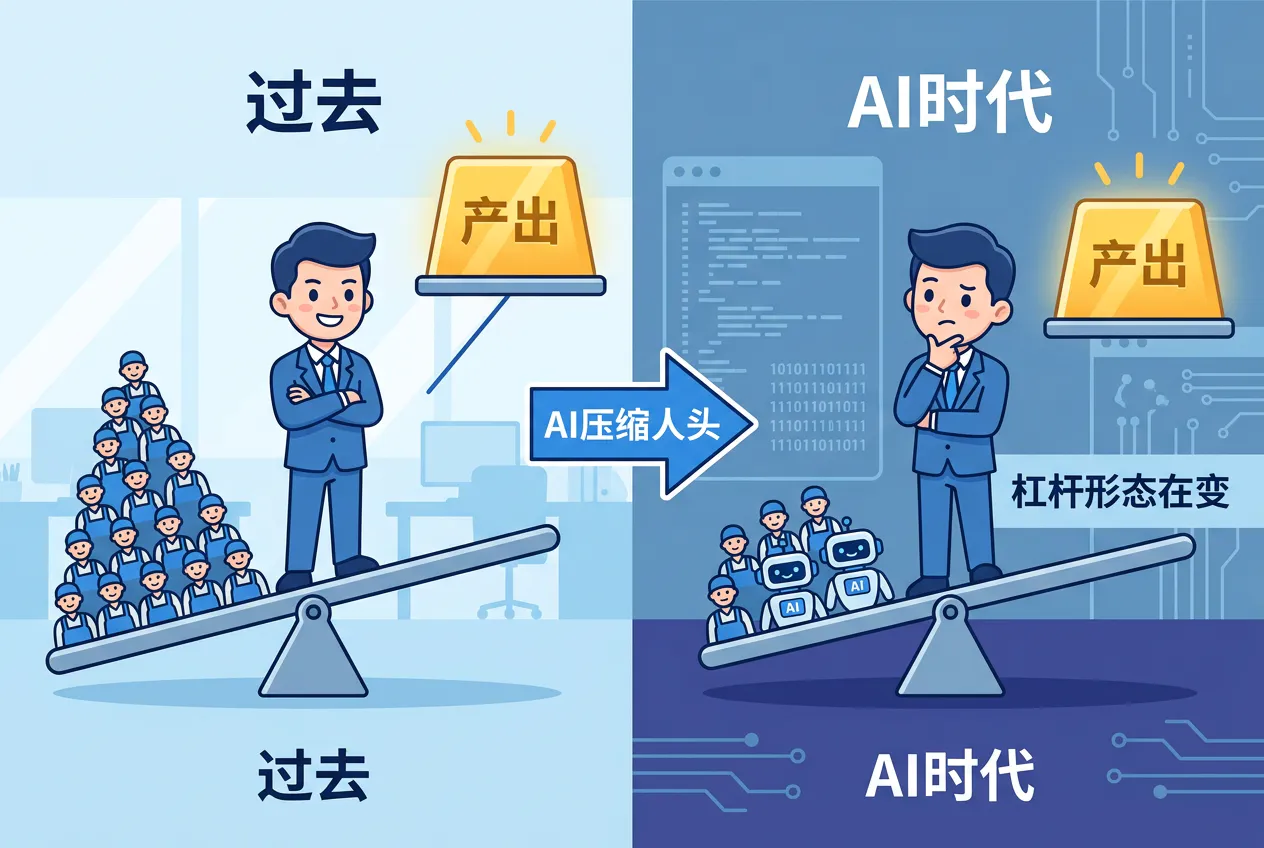

但注意:这个杠杆的前提是”需要管理大量人来完成大量代码”。 如果 AI 让三个人能做原来三十个人的事呢?

🔴 反方(我):你搞反了因果关系

你的整个论证有一个致命的方向性错误:你以为管理者的杠杆来自”人多”,但真相是反过来的——是因为有好的管理者,团队才能在规模扩大时不崩溃。

“杠杆在人不在代码”这句话,你只读懂了表面。让我告诉你它的真实含义。

一个管理者花 80% 时间写代码,问题不在于”浪费了管理时间”——而是在于他放弃了对系统性风险的感知能力。你写代码的时候是沉浸式的,你的注意力在函数和逻辑里,你看不到隔壁团队正在悄悄改你的上游接口,你看不到产品经理在给 CTO 画饼时承诺了一个根本做不到的时间线,你看不到你团队里那个最好的工程师已经在更新简历了。

管理者不写代码,不是因为代码不值钱,而是因为他需要保持一种”全局感知”的状态。 这种状态和深度编码是互斥的——你不可能同时在两个认知频道上工作。

而管理者的存在,本质上是对”人的能力上限”的一种组织级补偿机制。因为单个人不够用,所以要堆人;堆人就有协调问题,所以要管理者。AI 抬高了单人上限,但没有消灭协调本身。

你说 AI 会让团队从 30 人缩到 6 人?好,就算真的缩了。但你以为 6 个人就不需要管理了?

6 个人 + AI 组成的团队,系统复杂度不会比 30 人团队低——因为产出没有缩减,缩减的只是人头。 同样的系统复杂度、同样的跨团队依赖、同样的业务压力,只是用更少的人在承载。每个人的决策密度更高,出错的代价更大,对协调质量的要求反而更严苛。

打个比方:一架 F-35 的飞行员只有一个人,但你觉得他不需要指挥官了?恰恰相反——越是高度压缩的精锐单元,越需要战略层的协调和判断,因为每一个决策的杠杆率都被放大了。

我之所以能拿高薪,很大程度上正是因为团队规模大——管 30 个人的经理和管 5 个人的 Tech Lead,级别不同,薪资不同。但这不意味着团队缩小后管理就不需要了。团队缩小不会消灭管理需求,它会改变管理的形态——从”管人数”变成”管决策质量”。后者更难,不是更简单。

管 30 人的经理 vs 管 6 人的 Tech Lead:杠杆的形态在变,不是在消失

第三轮|我们当时在解决企业的什么问题?

🔵 正方:你们在解决”人多了之后的熵增”

让我用一个更锐利的框架来定义技术中层管理者过去在解决的问题:

你们在解决的,不是业务问题,不是技术问题,而是”大量认知劳动者协作时不可避免的组织熵增”。

具体来说:

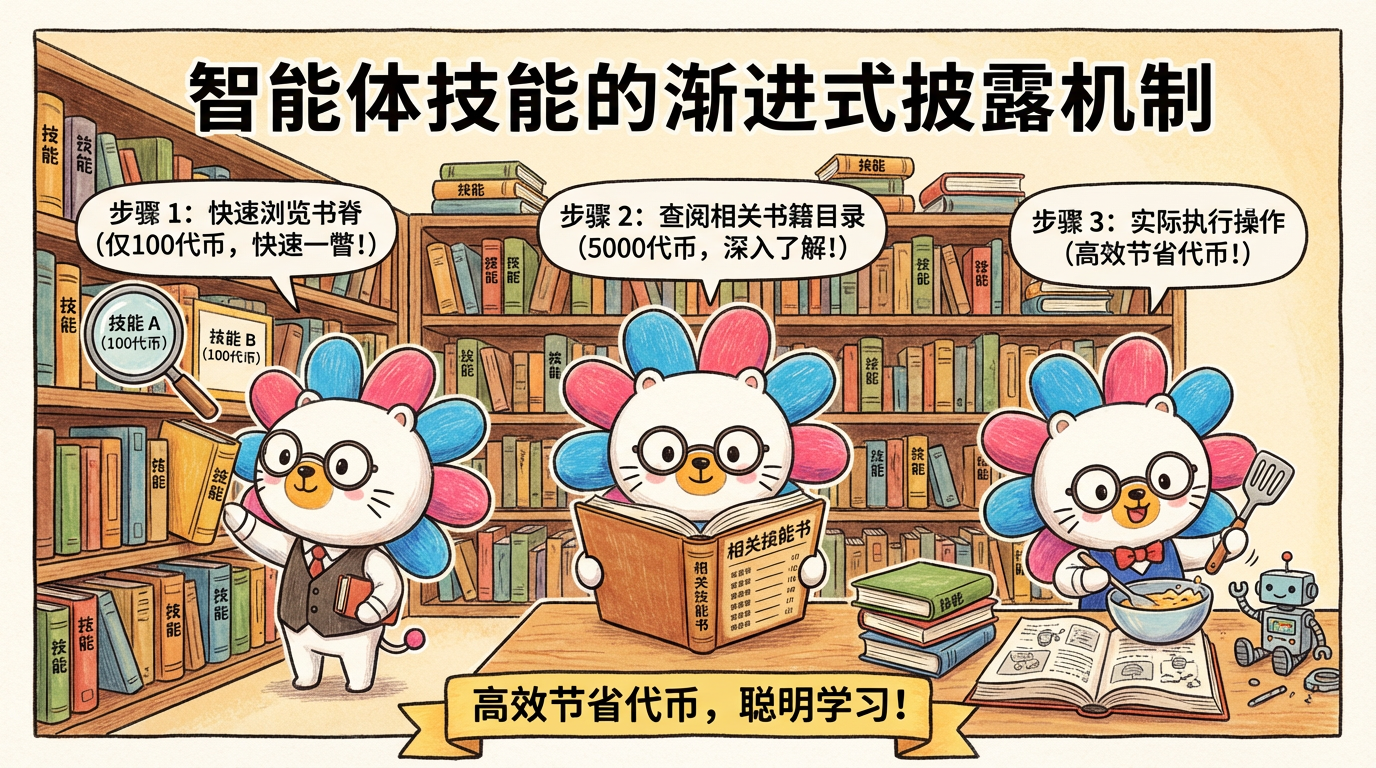

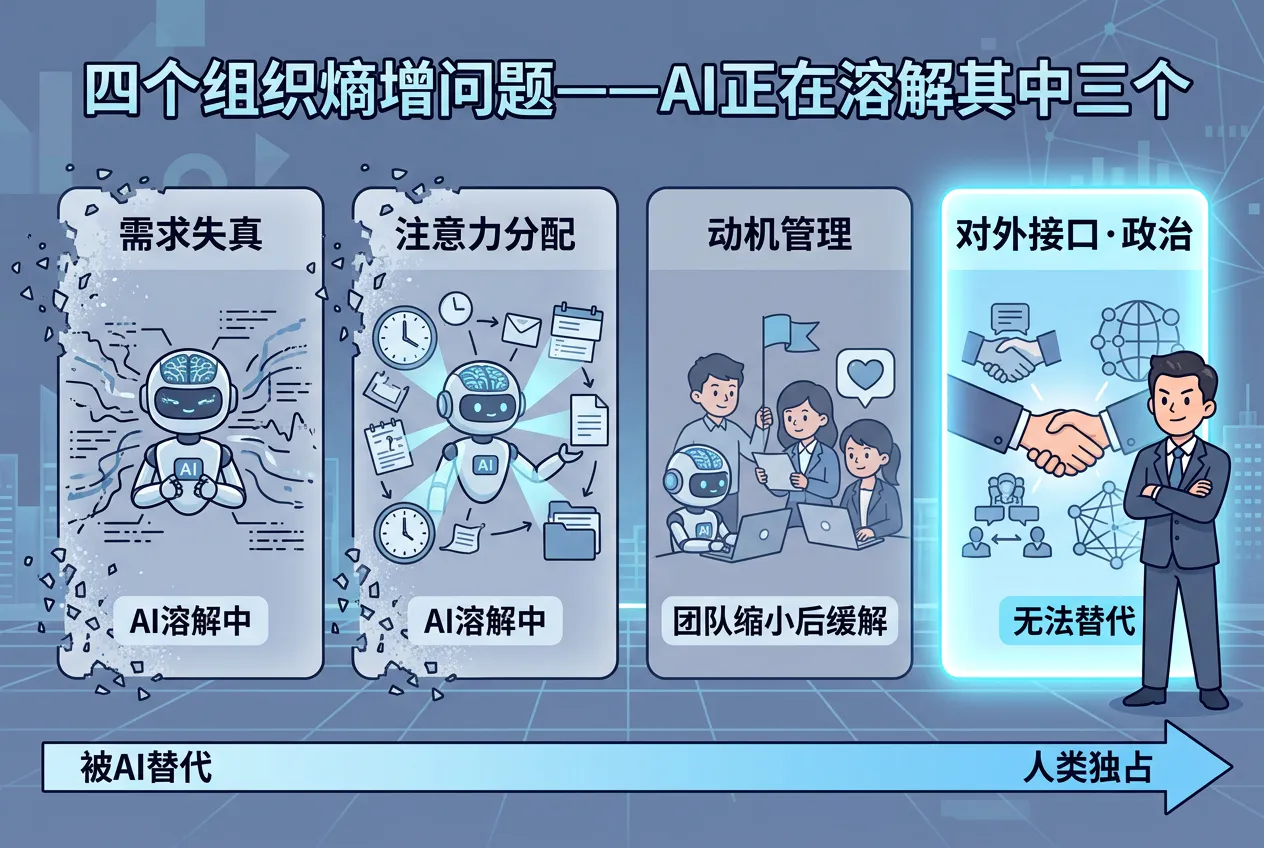

需求失真问题。 从业务到产品到技术的传递链条中,每一层都会丢失和扭曲信息。管理者用翻译和澄清来对抗这种失真。

注意力分配问题。 15 个工程师同时在做 15 件事,哪件最重要?谁在偏离方向?谁被卡住了?管理者用每日站会、周会、1:1 来维持全局视野。

动机管理问题。 人不是机器,有情绪、有职业焦虑、有人际摩擦。管理者要让人”愿意干”,而不只是”能干”。

对外接口问题。 跨团队依赖、业务方诉求、上级汇报——管理者是团队的对外 API。

现在注意,这四个问题的成因:

- 需求失真 → 因为人与人之间的自然语言沟通有带宽限制

- 注意力分配 → 因为人多了之后没人能自动看到全局

- 动机管理 → 因为你管的是有情绪的人类

- 对外接口 → 因为组织有边界、有层级、有政治

前两个问题,AI 可以直接溶解——AI Agent 可以做实时的需求澄清和全局进度跟踪,比人做得更全面更及时。

第三个问题在团队规模缩小后大幅缓解——6 个人的团队动机管理远比 30 个人简单。

真正剩下的只有第四个:对外接口。而这,就是我一直说的”政治性角色”。

需求失真、注意力分配被 AI 溶解,动机管理随团队缩小缓解,只有政治性角色无法替代

🔴 反方(我):你把”组织熵增”说得太轻了

你的分析框架很干净,但太干净了。

让我用真实经历来还原”组织熵增”到底有多脏:

上个季度,业务方说要做一个”智能推荐”功能。产品经理写了 PRD,看起来挺清楚。但我拿到之后发现三个问题:

第一,这个”智能推荐”的数据依赖于另一个团队还没上线的数据管道,PRD 里完全没提。不是产品经理不知道,而是他跟那个团队的负责人有过节,在回避这个依赖关系。

第二,CTO 在上周的架构评审里暗示过,他希望推荐系统用公司内部的模型平台来做,但没有明说——因为那个平台是他力推的项目,直接指定会有”既当裁判又当运动员”的嫌疑。

第三,我团队里最适合做这个项目的工程师,正在考虑跳槽,他在面试另一家公司。如果我把核心项目交给他,他走了怎么办?如果我不交给他,他会觉得被边缘化,走得更快。

这三个问题,哪一个是”信息传递损耗”?哪一个可以被 AI 的”实时需求澄清”解决?

都不是。它们的本质是人类组织中不可被形式化的政治暗流、情感博弈和信任网络。

你让 AI 去追问产品经理”数据管道的依赖关系是什么”,他可以回答。但你让 AI 去察觉”这个人在回避某个依赖是因为人际恩怨”——AI 连这个问题的存在都感知不到,因为这类信息从不出现在任何文档和对话的文字表层。

我的价值不是路由信息,是读懂组织的潜台词。

而”潜台词”这种东西,它的载体不是文字,是表情、语气、沉默、以及你在走廊里跟某个人闲聊时捕捉到的一句”最近有点累”。这类信息从不出现在任何文档和对话的文字表层,AI 的训练数据里也没有。

桌面上是 PRD,桌面下是人际恩怨、晋升博弈、CTO 的暗示——AI 只看到桌面

第四轮|未来会怎么变?

🔵 正方:你的价值会被压缩到一个非常窄的通道里

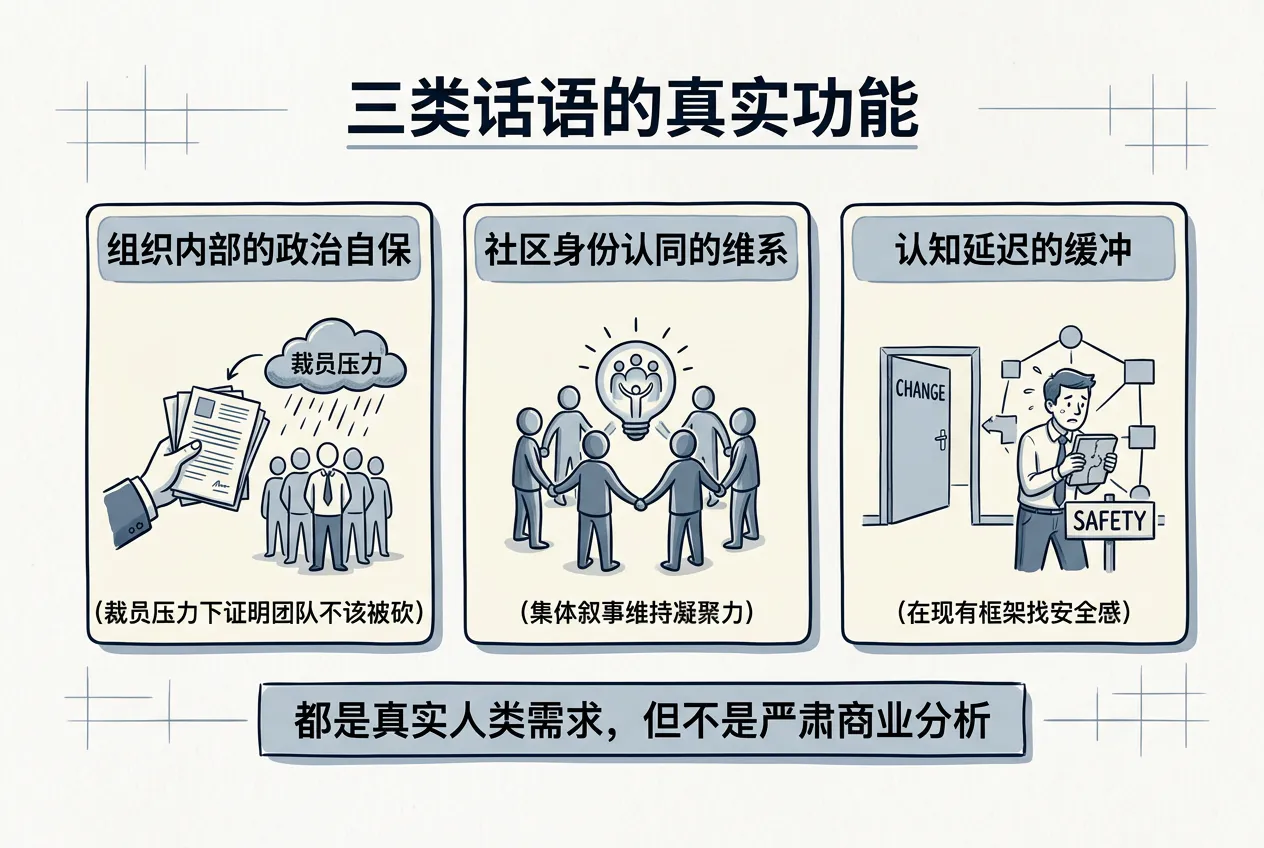

我承认你描述的那些场景是真实的。但让我提一个你可能不愿意面对的推论:

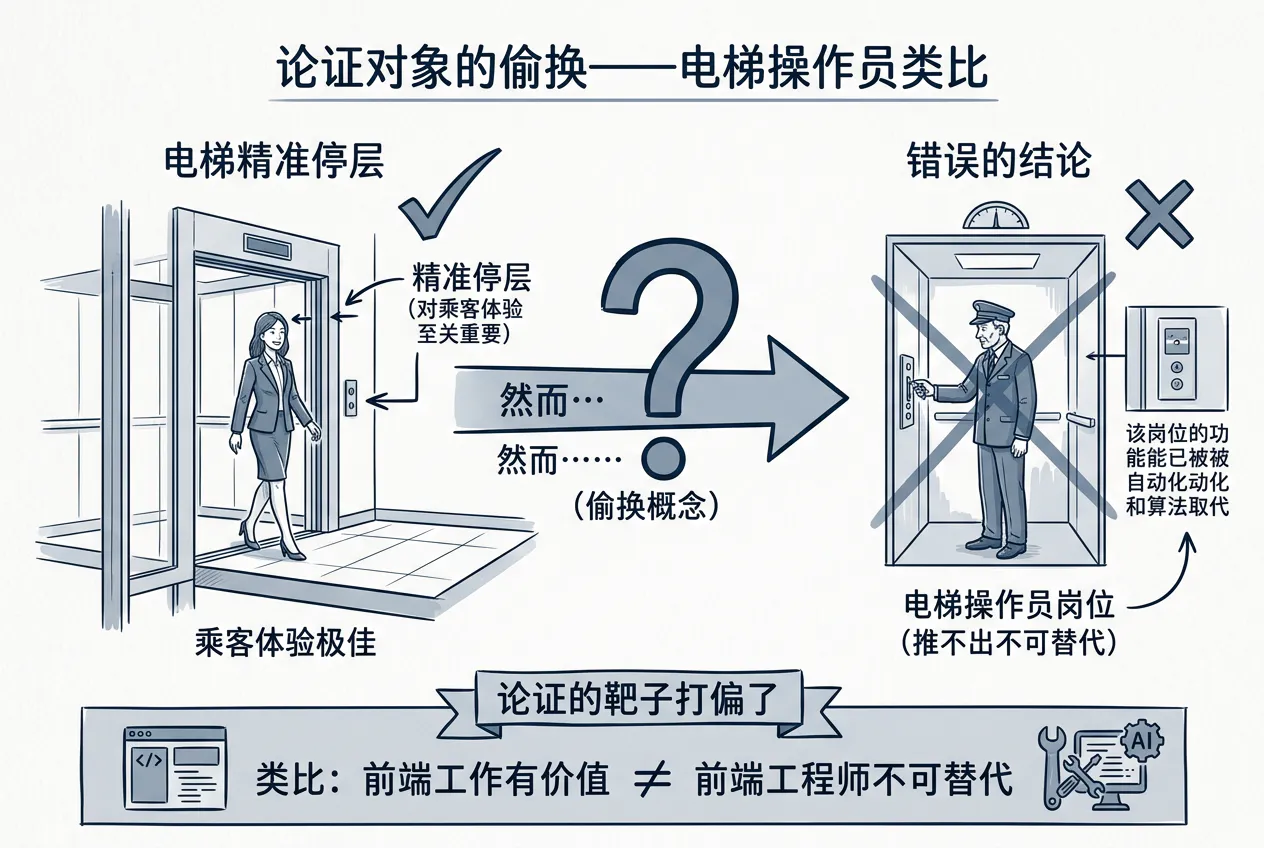

你描述的那些能力——读潜台词、处理政治暗流、管理信任网络——它们是真实的能力,但它们不是”技术中层管理者”特有的能力。

一个好的 HR BP 能做这些事。一个老练的 COO 能做这些事。甚至一个情商高的产品经理也能做这些事。

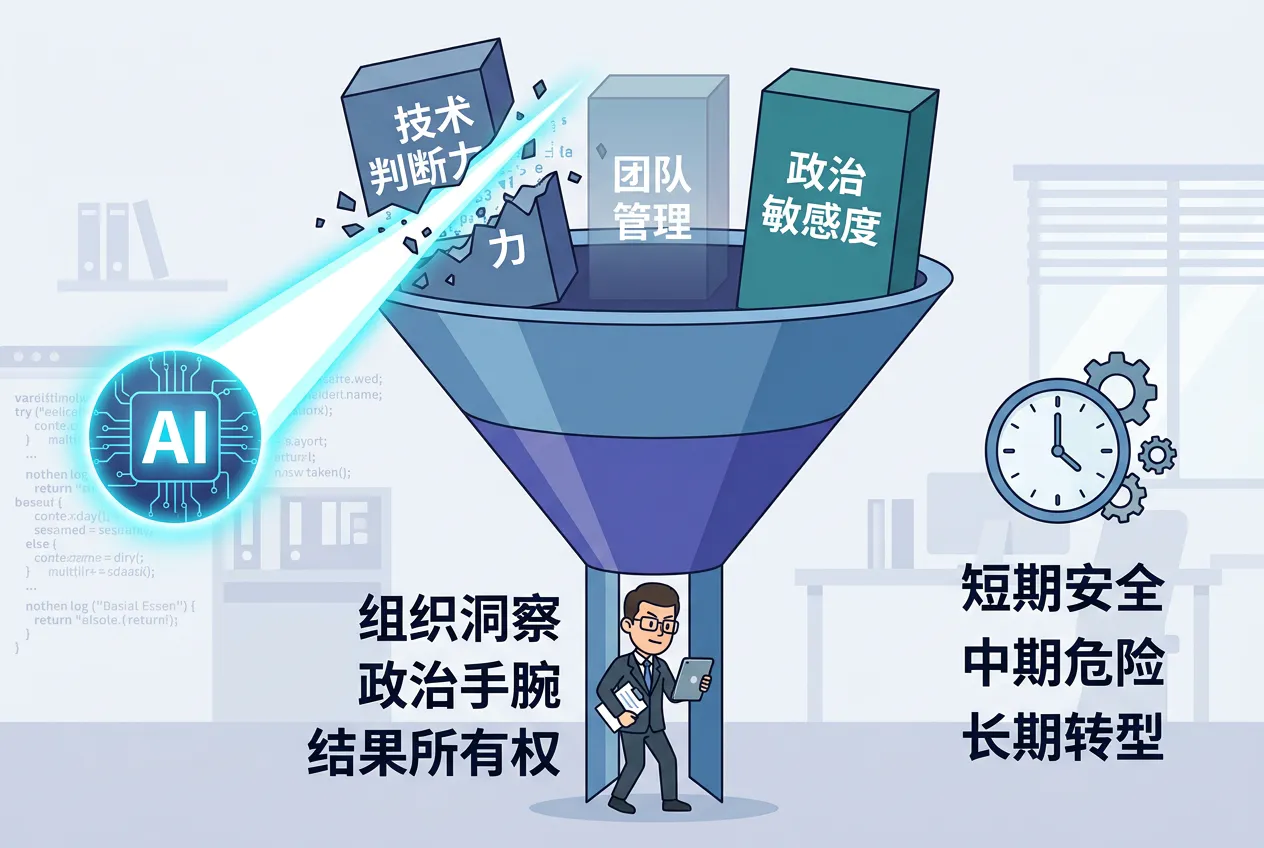

你之所以能在这个位置上做这些事,不是因为你是”技术管理者”,而是因为你恰好同时具备技术理解力和政治敏感度。这两种能力的叠加在过去是稀缺的——因为纯技术的人不愿意搞政治,纯管理的人不懂技术,你是中间那个稀缺的交集。

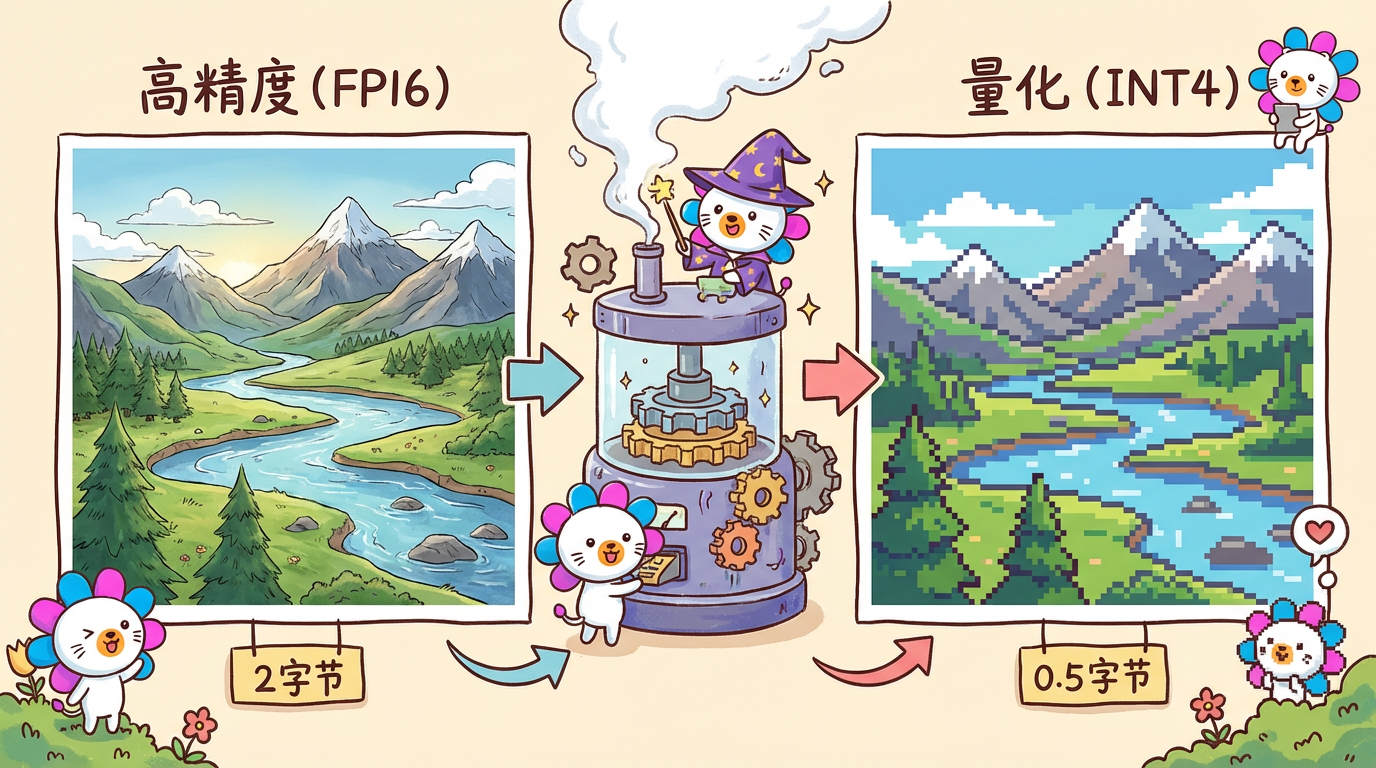

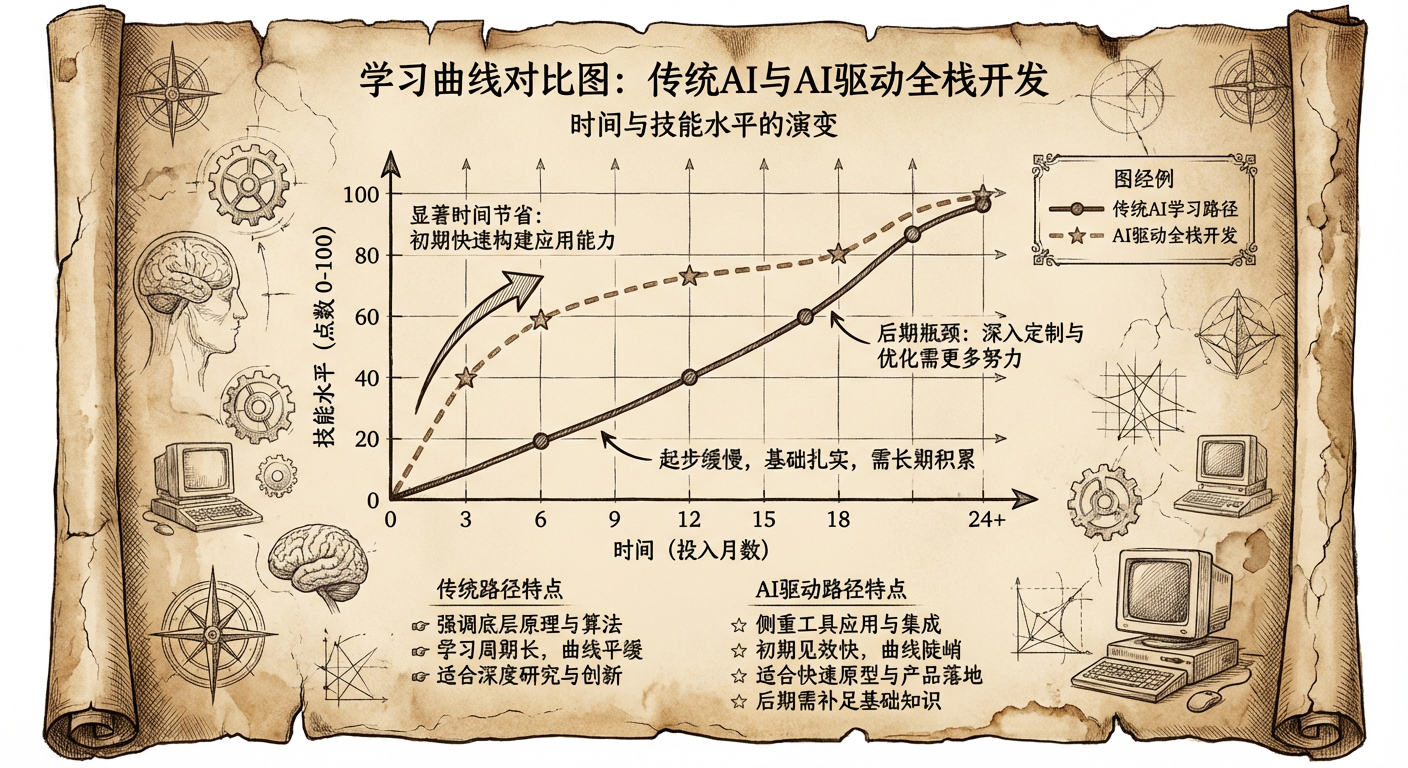

但 AI 正在溶解这个交集的稀缺性。

当一个非技术背景的管理者可以通过 AI 获得足够的技术判断力时——当他问 AI”这个技术方案靠谱吗””这个工期合理吗””这个架构选型有什么风险”并且能得到相当靠谱的回答时——“懂技术”这半边就不再是你独占的护城河了。

剩下的那半边——政治敏感度、信任网络、组织洞察——是你的真实能力,但它不需要”技术中层管理者”这个壳。它可以装在任何管理角色里。

所以未来的变化是:不是”技术中层管理者”这个岗位消失,而是它的壳被掏空——技术判断这半边被 AI 接管,人际政治那半边被泛化到更通用的管理角色中。最终留下的,是一个薄得多的、主要靠组织洞察力和政治手腕存活的角色。

而且——让我说得再直白一点——当团队从 30 人压缩到 6 人时,很多过去需要”管理”的问题自动消失了。 6 个人不需要站会,不需要复杂的排期,不需要跨组对齐,不需要写周报来让上面知道你在干什么。管理工作量和团队规模之间不是线性关系,是超线性关系——人减半,管理工作量可能降 70%。

🔴 反方(我):你在偷换”技术中层管理者”的定义

你的整个论证有一个隐蔽的偷换:你把”技术中层管理者”窄化成了”技术翻译官”,然后论证翻译官可以被替代。

但我不是翻译官。让我告诉你一个非技术背景的管理者——哪怕装备了最强的 AI——在我的位置上会出什么问题。

上个月,基础架构团队提了一个方案,要把核心服务从单体迁移到微服务。AI 会告诉你这个方案”技术上可行”,甚至能给你列出利弊清单。但我看到的是另一件事:这个方案是架构组的负责人在为明年的晋升铺路。 他需要一个足够大的”技术变革”项目来撑起他的晋升述职,而微服务迁移是最容易包装成”战略级项目”的选项。

问题是,我们现在的业务体量根本不需要微服务。迁移会消耗两个季度的工程资源,期间业务需求会被大幅压缩。但如果我直接否掉,架构组负责人会觉得我在打压他的发展,这会影响我们两个团队后续至少一年的协作关系。

我最终的处理方式是:在季度规划会上,先肯定微服务方向的长期价值,然后提出”分阶段落地”——第一阶段只做最有业务价值的一个服务的拆分,作为 POC。这样既给了他一个可以写进述职里的项目,又把资源消耗控制在可接受范围内,同时如果 POC 效果不好,后续阶段自然就搁置了。

这个决策的每一步,都不是”技术判断”,而是对人的动机、组织的权力结构、时间节奏的综合把控。 AI 给你的技术分析再靠谱,一个不懂这些暗线的管理者也会做出灾难性的决策——要么硬怼导致关系破裂,要么全盘接受导致资源浪费。

你说我的能力可以装在”任何管理角色”里?不行。因为如果我不懂技术,我连”微服务迁移是不是真正必要”这个判断都做不出来,我就会被技术叙事裹挟。 AI 能告诉你”技术上可行”,但它不会告诉你”这个人在用技术叙事来服务他的政治目的”——识别这一层,既需要技术直觉,也需要组织嗅觉,缺一不可。

所以别跟我说”懂技术”这半边可以被 AI 替代。真正的技术判断力不是”知道微服务是什么”,而是”知道什么时候有人在用微服务忽悠你”。 这种嗅觉来自十年以上的技术浸泡,不是问 AI 一句”这个方案靠谱吗”能获得的。

你说组织的演化速度远远慢于技术的演化速度?对,这恰恰是我的护城河。AI 可以在一年内革新工程效率,但公司的组织架构、汇报关系、晋升体系、权力格局,这些东西的变化周期是以十年计的。 在这个漫长的过渡期里,理解并驾驭这套”旧系统”的人,恰恰是最不可替代的。

正方说价值通道在压缩,反方说那条”窄缝”恰恰是最深的护城河

终局思考:从管理者到什么?

辩到这里,双方都没有说服对方——正方坚持结构性崩塌不可逆转,反方坚持组织的非形式化暗面无法被替代。但两边都同意一件事:这个角色一定会变,区别只在于变成什么。

不管你站哪边,有一个实操问题绕不过去:

如果变化真的来了,应该往哪个方向演化?

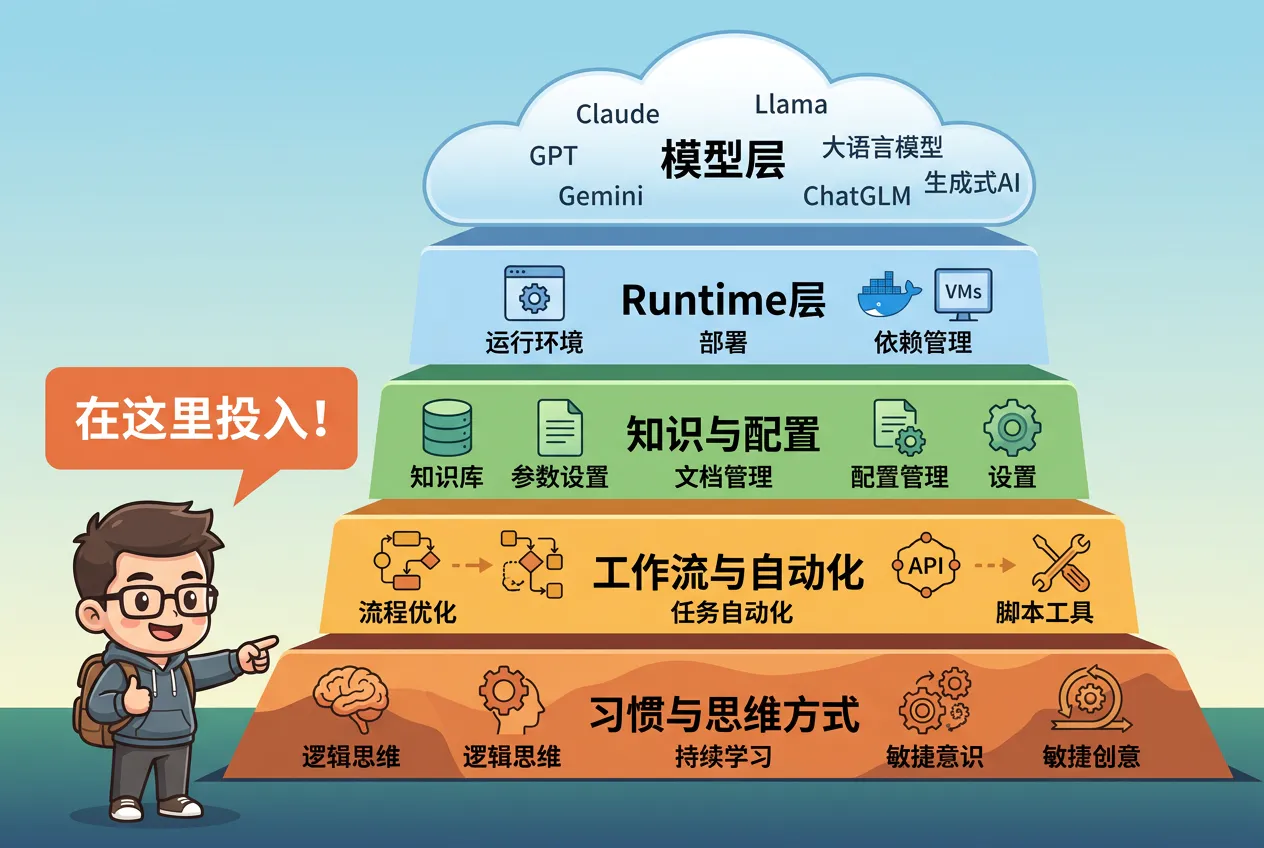

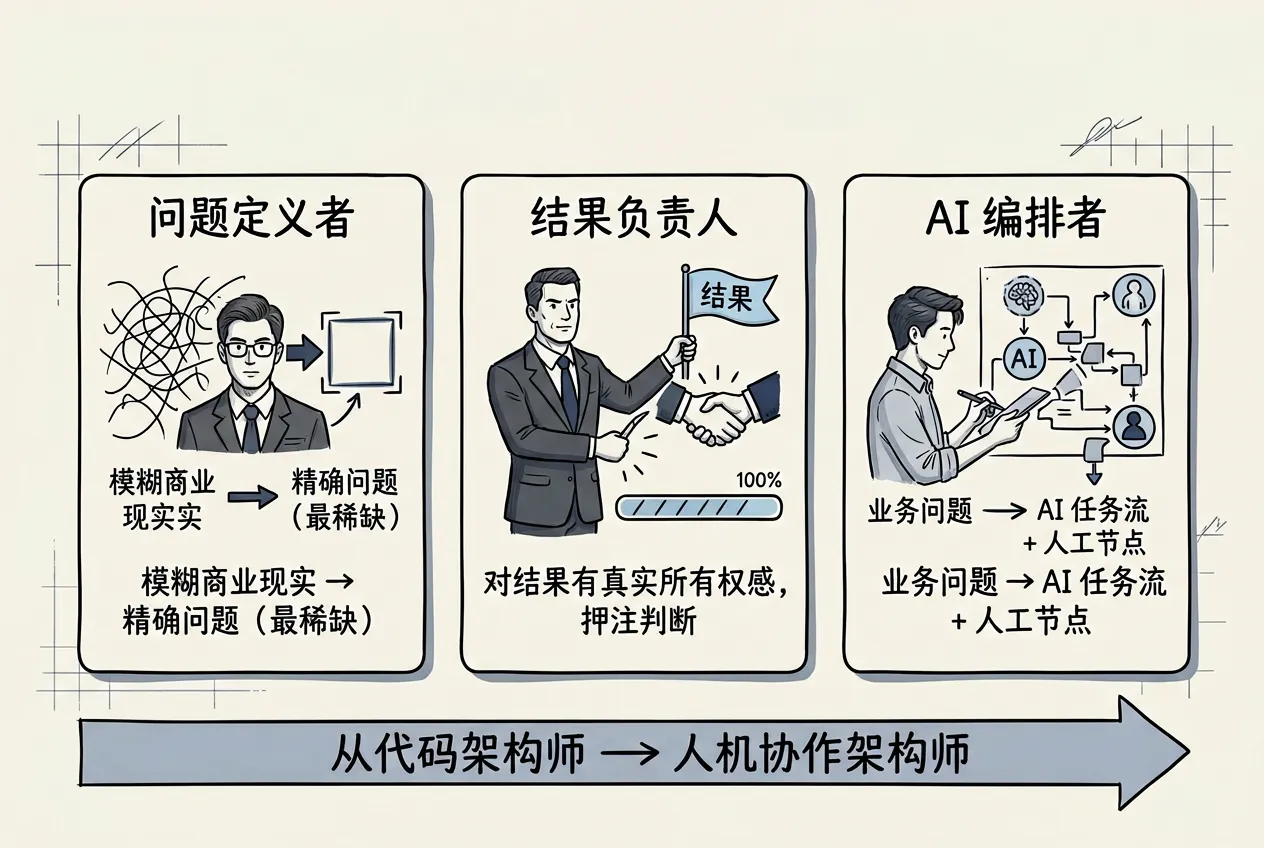

方向一:从管人变成管”人+AI”混合系统

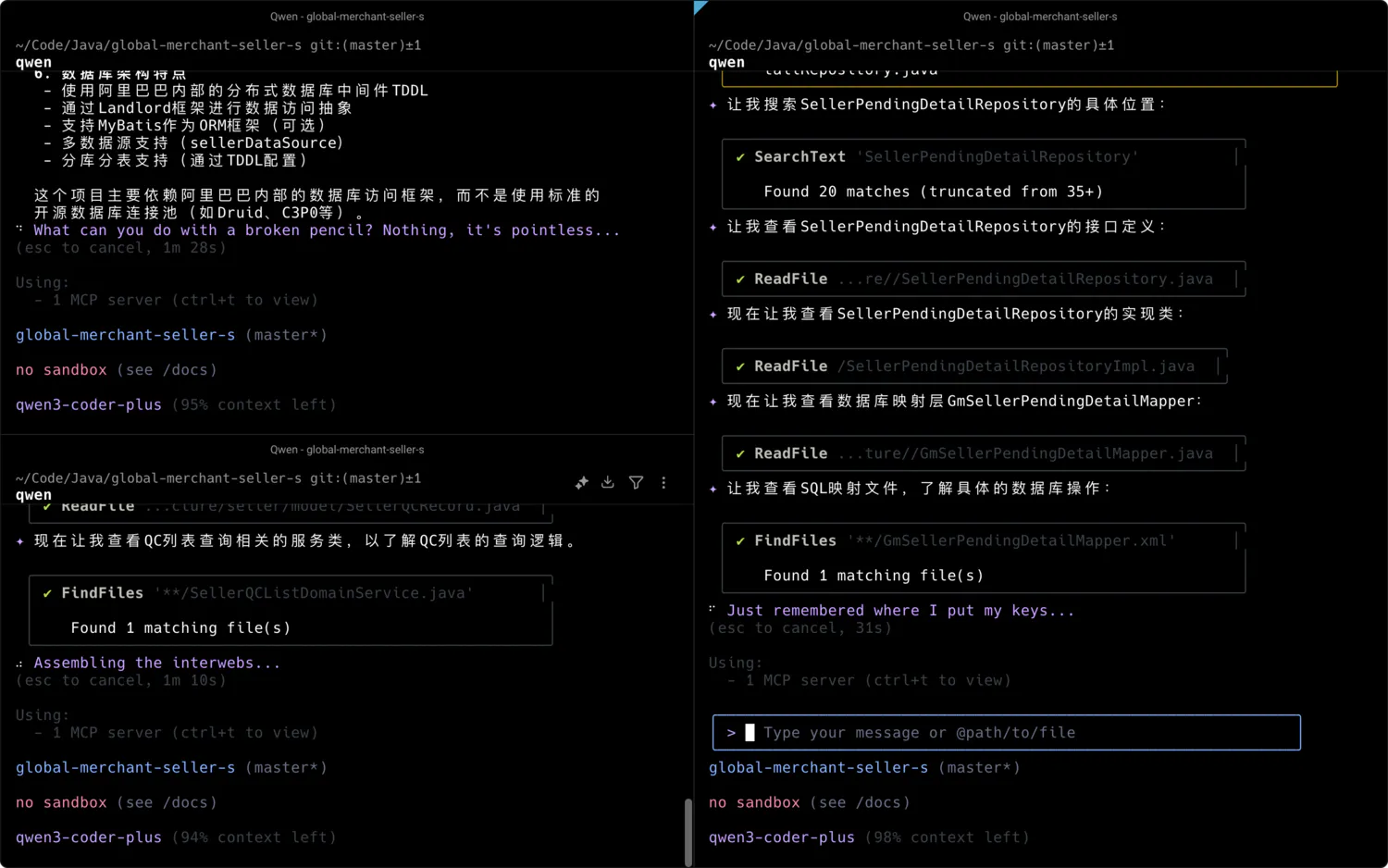

过去我管的是人,未来我管的是一个由少量人和大量 AI Agent 组成的混合团队。这听起来像是换了个壳,但实际上决策模式完全不同。

管人的核心是激励和协调——你得让人愿意干,然后帮他们不要互相打架。

管”人+AI”混合系统的核心是编排和质量控制——你得知道哪些任务可以全权交给 AI、哪些需要人工介入、在哪个节点做质量检查、AI 出错时的回退策略是什么。

这更接近系统架构师的思维,只不过架构的对象不是代码模块,而是任务流和决策流。

方向二:从技术管理者变成”问题承包商”

过去公司雇我,是因为”这个技术团队需要一个 manager”。未来公司雇我,应该是因为”这个业务问题需要一个人来扛”。

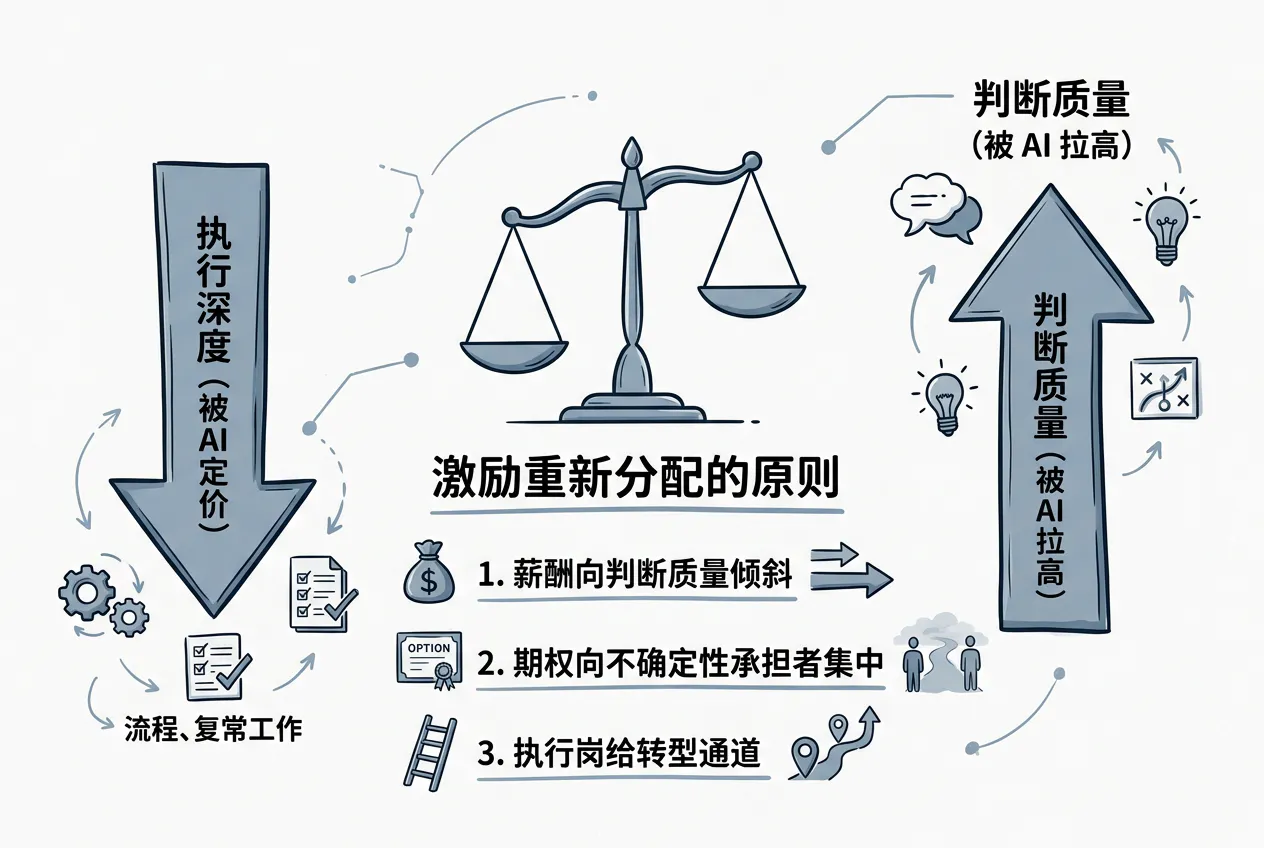

区别在哪?前者的价值锚定在角色上——你是 manager,所以你有价值;后者的价值锚定在结果上——你能搞定这件事,所以你有价值。

对于我这种已经远离代码的管理者来说,”搞定事情”的能力不在于技术深度,而在于:能否在一团乱麻的组织现实中,找到正确的问题、调动正确的资源(包括 AI)、做出正确的取舍、然后为结果负责。

这个能力组合在 AI 时代反而更稀缺了——因为 AI 能做的事变多了,”在所有 AI 能做的事情之间做选择”这件事变得更难了。

方向三:老实承认——有些人该退场了

这个方向不好听,但必须说。

不是所有技术中层管理者都具备我上面说的那些能力。过去很多人坐上这个位置,不是因为他们有组织洞察力或政治智慧,而是因为他们是团队里技术最好的那个人,然后被”彼得原理”提拔到了管理岗。

这类管理者的真实能力组合是:中上水平的技术能力 + 及格线水平的管理能力。在过去,这个组合够用了,因为技术判断力本身就值很多钱。但当 AI 把技术判断力的稀缺性大幅压缩之后,剩下的”及格线管理能力”撑不起一个高薪岗位。

对于这类同行,最诚实的建议不是”学习如何管 AI”,而是”认真考虑要不要回到技术执行线上”——在 AI 的加持下做一个产出极高的个人贡献者,可能比继续当一个越来越空心化的管理者更有前途。

从管理者到什么?管人+AI混合系统 / 问题承包商 / 回归个人贡献者

收束

回到最初的四个问题:

1. 为什么之前会有大量这样的岗位存在,并且能拿到高薪?

因为软件工程的组织复杂度和人的认知上限之间有结构性矛盾——需要大量人才能完成工作,大量人协作就产生了巨大的管理需求。技术中层管理者的高薪,买的不是他们的代码,是他们对组织熵增的压制能力。

2. 他们当时在解决企业的什么问题?

信息失真、注意力分配、动机管理、对外接口。但最核心的——也是最不被明确承认的——是在组织的政治暗流中保护技术团队的产出效率。这是一个脏活,但极有价值。

3. 为什么之前会说”如果你花 80% 的时间还在 Coding,那你不配当一个管理者”?

因为你的杠杆在人,不在代码。当你管 30 个人时,对团队整体效率的 10% 提升,比你个人多写 50% 的代码值钱得多。但这个逻辑的地基是”团队足够大”——当 AI 把团队压缩到 6 个人时,这句话的力度大打折扣。

4. 在未来又会有什么变化?

团队规模缩小,管理工作量超线性下降。技术判断力被 AI 普及化,”懂技术”不再是管理者的独占优势。纯管理型角色被压缩到”组织洞察 + 政治手腕 + 结果所有权”这个非常窄的价值通道里。

最后一句话给所有和我一样的技术中层管理者:

过去,我们的价值是”让一大群工程师高效运转”。未来,我们的价值是”在 AI 能做一切执行工作的前提下,做那些 AI 做不了的判断——然后为这些判断的后果买单”。

如果你对自己的判断力有信心,这是一个更好的时代——因为判断力终于可以从繁琐的协调事务中解放出来了。

如果你对自己的判断力没有信心——那坦率说,你过去的高薪可能买的不是判断力,而是”看起来在管理”的外壳。这个外壳正在被 AI 一层一层剥掉。

]]>